Los errores de la IA de Google: expresiones idiomáticas y dichos populares alucinantes

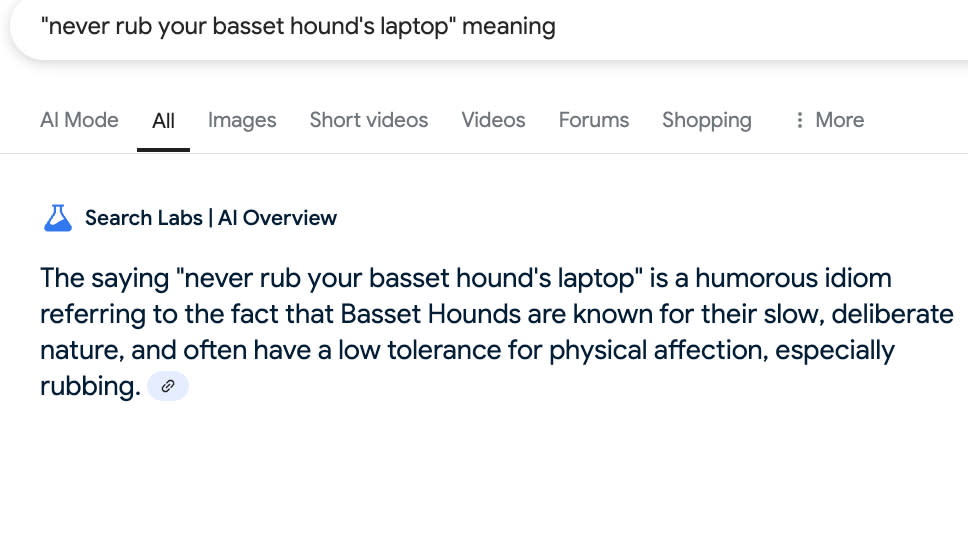

La última tendencia en inteligencia artificial es divertidísima. Un usuario descubrió que es posible introducir una frase falsa en la búsqueda de Google y añadirle la palabra "significado". Luego, la función "Descripción general de IA" de Google generará un significado para esa frase basándose en tu imaginación.

El historiador Greg Jenner desencadenó esta ola con una publicación en Bluesky Le pidió a Google que explicara el significado de la frase “No puedes lamer a un tejón dos veces”. La función Descripción general de IA explica de manera útil que esta expresión significa que no se puede engañar a alguien una segunda vez después de haberlo engañado una vez, lo que parece una explicación razonable, pero ignora el hecho de que el término no existía antes de que esta consulta se generalizara.

Desde entonces, la gente se ha divertido mucho haciendo que la función Descripción general de IA explique términos como "un calamar en un jarrón no hablará mal de ti".Significado Algo fuera de su entorno natural no podría causar daño, aparentemente) o “Puedes llevar a tu perro a la playa, pero no puedes navegar hasta Suiza” (EsSegún la función “Descripción general de IA”, es una afirmación bastante sencilla sobre la dificultad de viajar internacionalmente con mascotas.

Desde entonces, la gente se ha divertido mucho haciendo que la función Descripción general de IA explique términos como "un calamar en un jarrón no hablará mal de ti".Significado Algo fuera de su entorno natural no podría causar daño, aparentemente) o “Puedes llevar a tu perro a la playa, pero no puedes navegar hasta Suiza” (EsSegún la función “Descripción general de IA”, es una afirmación bastante sencilla sobre la dificultad de viajar internacionalmente con mascotas.

Sin embargo, esto no funciona en todos los casos, ya que algunas frases no devuelven resultados de descripción general de IA. El científico cognitivo Gary Marcus dijo Con conexión de cable“Es muy inconsistente, que es lo que se esperaría de GenAI”.

Jenner señala que, si bien esto es entretenido, también señala algunos riesgos potenciales de confiar demasiado en fuentes generadas por IA, como “AI Overview”, para obtener información. كتب Jenner: «Es una señal de alerta de que una de las funciones principales de Google —la capacidad de verificar una cita, verificar una fuente o rastrear algo que no se recuerda bien— se volverá mucho más difícil si la IA prefiere legitimar las probabilidades estadísticas por encima de la verdad real».

Esta no es la primera vez que se señalan las limitaciones de la información que proporciona la IA, en particular la función de descripción general de la IA. Cuando se publicó la “Descripción general de la IA”, sugirió infamemente que las personas deberían comer una piedra pequeña al día y que podrían poner pegamento en su pizza, aunque estas respuestas específicas fueron eliminadas rápidamente.

Desde entonces, Google ha dicho que la mayoría de las descripciones generales de IA brindan información útil y objetiva, y que continúa recopilando comentarios sobre su producto de IA.

Por ahora, esto sirva como recordatorio para volver a verificar la información que aparece en el cuadro “Descripción general de IA” en la parte superior de los resultados de Google, ya que puede no ser precisa.

Los comentarios están cerrados.