Microsoft lanza Phi-4: un modelo de IA superinferencial para competir con DeepSeek R1

Resumen:

- Microsoft ha lanzado modelos de IA inferencial Phi-4, entrenados con 14 mil millones y 3.8 mil millones de parámetros.

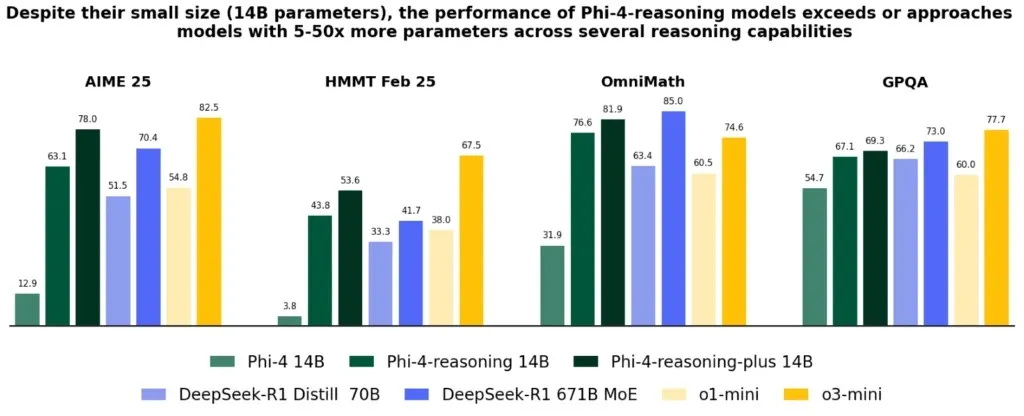

- A pesar de su pequeño tamaño, los modelos de inferencia Phi-4 compiten con modelos mucho más grandes como el DeepSeek R1 y el o3-mini.

- Microsoft dice que los modelos de inferencia Phi-4 pueden ejecutarse en PC con Windows Copilot+, gracias a su pequeño tamaño.

Microsoft ha lanzado tres nuevos modelos de IA deductiva: Phi-4-reasoning, Phi-4-reasoning-plus y Phi-4-mini-reasoning. Se trata de pequeños modelos de lenguaje, diseñados para dispositivos terminales como ordenadores Windows y dispositivos móviles. El modelo de IA de razonamiento Phi-4 está entrenado con 14 mil millones de parámetros y puede realizar tareas de inferencia complejas.

El modelo Phi-4-reasoning-plus utiliza el mismo modelo básico, pero utiliza un cálculo de tiempo de inferencia adicional, aproximadamente 1.5 veces el número de tokens en comparación con el Phi-4-reasoning, para proporcionar una mayor precisión. A pesar de su pequeño tamaño, los modelos de Phi-4-reasoning son competitivos con modelos más grandes, como Búsqueda profunda R1 671B y o3-mini.

En el estándar GPQA, el modelo Phi-4-reasoning-plus-14B alcanza una puntuación del 69.3%, mientras que el o3-mini 77.7%. A continuación, en la prueba AIME 2025, el Phi-4-reasoning-plus-14B obtiene un 78% y el o3-mini obtiene un 82.5%. Continúa demostrando que el modelo pequeño de Microsoft está muy cerca de los modelos de inferencia principales, que son de tamaño mucho mayor.

Microsoft dice que los modelos de inferencia Phi-4 fueron entrenados a través de un ajuste fino supervisado.Sobre demostraciones de inferencia cuidadosamente seleccionadas de OpenAI o3-mini. Además, Microsoft escribe: “El modelo demuestra que el formato de datos preciso y los conjuntos de datos sintéticos de alta calidad permiten que los modelos más pequeños compitan con los modelos más grandes.."

Aparte de eso, el modelo de razonamiento Phi-4-mini más pequeño, entrenado con solo 3.8 mil millones de parámetros, supera a muchos modelos 7B y 8B. En puntos de referencia como AIME 24, MATH 500 y GPQA Diamond, el modelo Phi-4-mini-reasoning-3.8B ofrece resultados competitivos, acercándose al o1-mini. Se completó "AjustarModelo Phi-4-miniUtilizando con precisión datos sintéticos generados por el modelo Deepseek-R1."

Los modelos Phi de Microsoft ya se utilizan de forma nativa en los ordenadores Windows. PC copiloto+Se beneficia de la unidad de procesamiento neuronal incorporada. Será interesante ver cómo los modelos de inferencia Phi-4 mejoran el rendimiento de la IA en el dispositivo.

Los comentarios están cerrados.