Modelos de IA: enormes capacidades, pero se quedan cortos en la industria de los videojuegos

A medida que las herramientas de IA siguen evolucionando, se nos anima constantemente a delegarles tareas complejas. Los modelos de lenguaje grandes puedenLLM) Escribir nuestros correos electrónicos, crear presentaciones, diseñar aplicaciones, crear vídeos, buscar en Internet y resumir hallazgos, y mucho más. Sin embargo, hay algo que todavía me resulta muy difícil: los videojuegos.

En lo que va del año, dos de las mayores empresas de IA (Microsoft y Anthropic) han intentado conseguir que sus modelos creen o ejecuten juegos, y los resultados son probablemente mucho más limitados de lo que mucha gente espera. Esto resalta los desafíos actuales de la IA generativa, especialmente en tareas que requieren planificación estratégica a largo plazo y toma de decisiones complejas.

Esto los convierte en demostraciones perfectas de lo que realmente es la IA generativa en la actualidad: en resumen: puede hacer mucho más que antes, pero no puede hacerlo todo. Esto refleja que la IA generativa aún está en su etapa de desarrollo y que, a pesar de sus crecientes capacidades, aún enfrenta limitaciones en algunas áreas.

Microsoft produce Quake II con inteligencia artificial

La producción de videojuegos enfrenta desafíos similares a los que se encuentran en la producción de video, donde el movimiento es extraño y distorsionado, y la inteligencia artificial comienza a perder el contacto con la “realidad” después de un cierto período de tiempo. El último intento de Microsoft, que Cualquiera puede probarlo.Es una versión generada por IA de Quake II.

He jugado el juego varias veces y es una experiencia realmente extraña, con enemigos desorientadores que aparecen de la nada y el entorno que te rodea cambia a medida que te mueves. Muchas veces, cuando entraba en una habitación nueva, la puerta desaparecía cuando me giraba para mirarla, y cuando volvía a mirar hacia adelante, las paredes se habían movido.

La experiencia solo dura unos minutos antes de detenerse y solicitarte que comiences un nuevo juego, pero si no tienes suerte, puede dejar de responder a tus entradas correctamente incluso antes de eso.

Sin embargo, es una gran experiencia y creo que sería beneficioso que más gente la viera. Le permite experimentar por sí mismo en qué es buena la IA generativa y cuáles son sus limitaciones actuales. Si bien es impresionante que hayamos podido crear una experiencia de videojuego interactiva, es difícil imaginar que alguien pueda jugar esta demostración de tecnología y creer que el próximo Assassin's Creed será producido por IA.

Sin embargo, este tipo de ideas y suposiciones existen, en gran medida porque la gente no puede evitar oír hablar de IA en este momento. Incluso aunque no te importe en absoluto la IA, te la impondrán dondequiera que vayas. El problema es que la información que recibe la persona promedio consiste casi en su totalidad en comentarios de marketing de grandes empresas tecnológicas y comentarios de ejecutivos recogidos por publicaciones de noticias.

Esto significa que escuchan afirmaciones exageradas y contradictorias como éstas:

Tiene el potencial de resolver algunos de los mayores problemas del mundo, como el cambio climático, la pobreza y las enfermedades. (Bill Gates)

Es probable que en 2025, en Meta, junto con otras empresas que trabajan principalmente en esto, tengamos una IA que pueda actuar como su ingeniero de nivel medio en su empresa y pueda escribir código de manera eficiente. (mark Zuckerberg)

El uso efectivo de la IA es ahora una expectativa básica para todos en Shopify. Es una herramienta para todas las profesiones hoy en día, y sólo adquirirá mayor importancia con el paso del tiempo. Francamente, no creo que sea posible evitar aprender la habilidad de aplicar IA en su negocio. (Toby Lutke, director ejecutivo de Shopify)

Ahora estamos seguros de que sabemos cómo construir la inteligencia artificial general (AGI) tal como la hemos entendido tradicionalmente. Creemos que en 2025 podremos ver a los primeros agentes de IA “unirse a la fuerza laboral” y cambiar fundamentalmente la forma en que las empresas producen. (Sam Altman, director ejecutivo de OpenAI)

La inteligencia artificial es más peligrosa que, por ejemplo, un diseño de aeronaves mal gestionado, un mantenimiento de producción deficiente o una producción de automóviles de mala calidad, en el sentido de que tiene el potencial —por pequeño que sea, pero no trivial— de destruir la civilización. (Elon Musk)

Todo esto suena un poco exagerado ¿no? Se supone que debe salvarnos y destruirnos al mismo tiempo, ser una herramienta para profesionales y una herramienta que los reemplazará, y parece que podríamos estar obteniendo una AGI de nivel de ciencia ficción tan pronto como este año. Cuando la gente escucha todo esto, empiezan a esperar cosas increíbles de estos aparatos y creen que todos los trabajadores de oficina pasan sus días hablando con sus computadoras como personajes de Star Trek.

Sin embargo, la realidad no es así. La realidad parece Quake II, inestable y borrosa con formas enemigas ininteligibles. Los modelos LLM de nivel ChatGPT ya fueron un gran avance en 2022 y muy divertidos para todos, pero para la mayoría de los usos que las grandes empresas tecnológicas nos están imponiendo ahora, la IA simplemente no es lo suficientemente capaz. Los niveles de precisión son muy bajos, las habilidades para seguir instrucciones son muy bajas, los rangos de contexto son muy pequeños y solo se entrenan con jerga de Internet en lugar de con conocimiento del mundo real.

Pero crear un videojuego es un objetivo extremadamente complejo: después de todo, equipos enteros de personas necesitan años para crear estas cosas. ¿Qué tal si en lugar de eso jugamos a videojuegos?

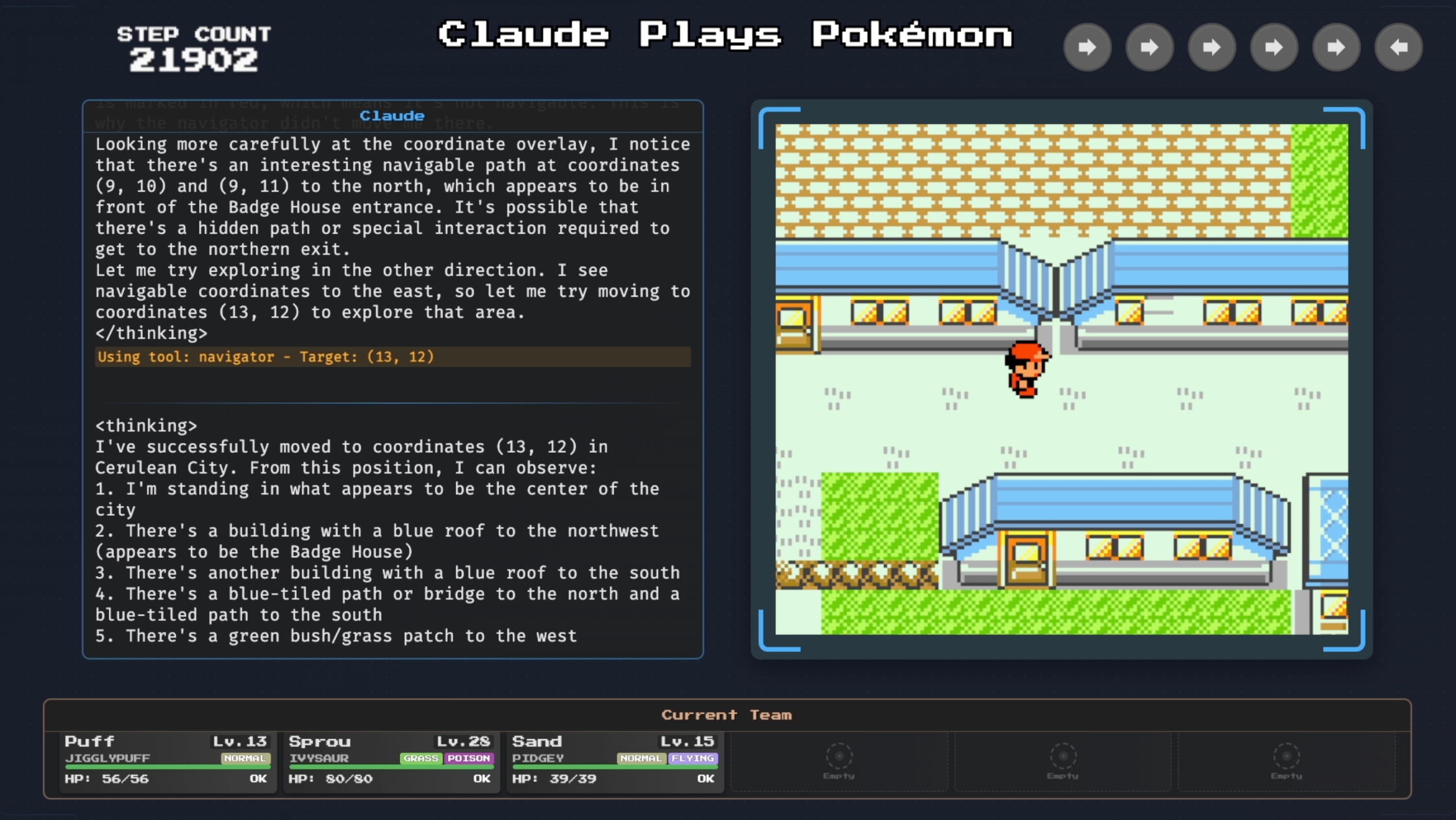

Claude "juega" a Pokémon Rojo

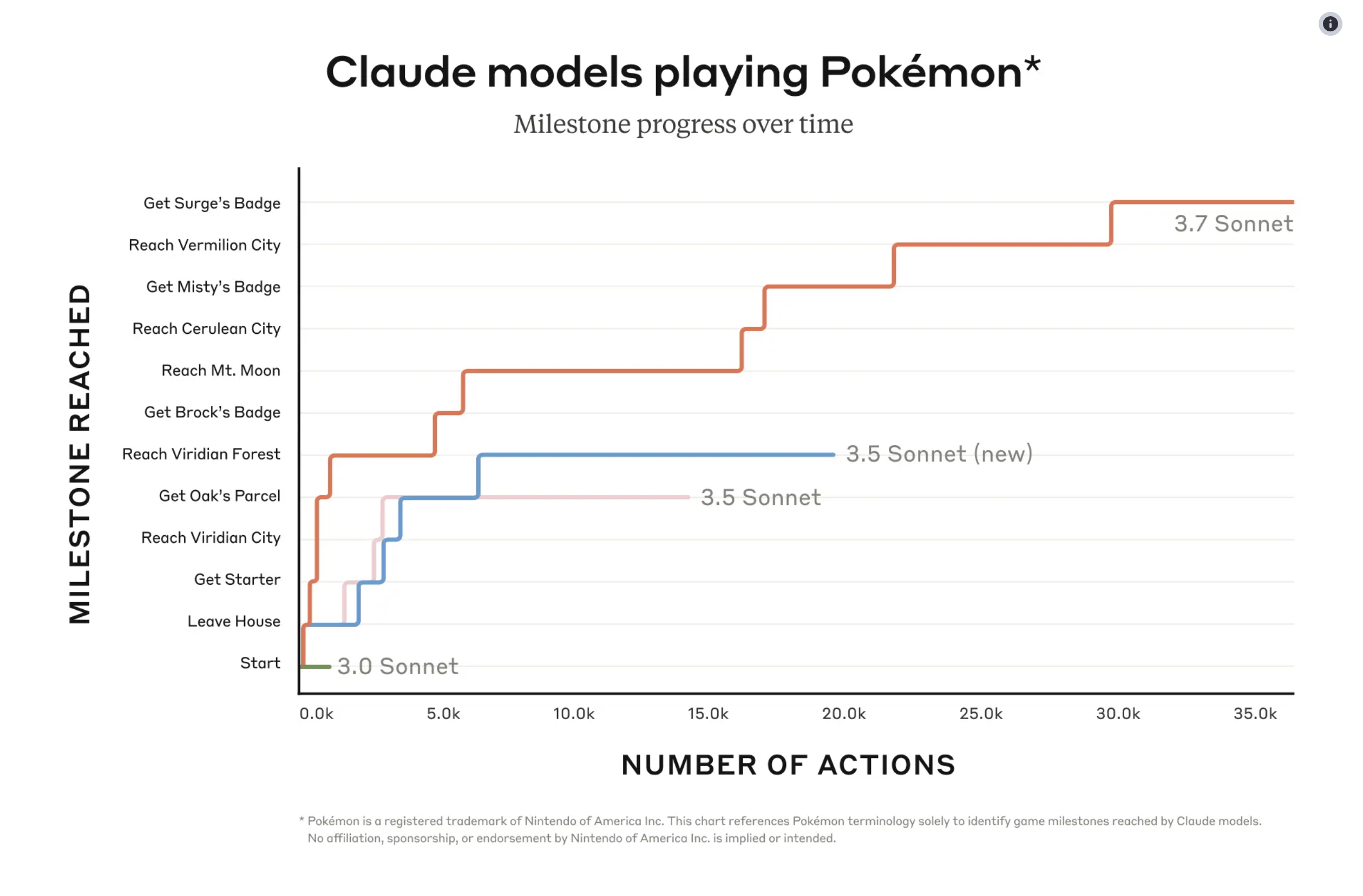

Bueno, resulta que la gente también está experimentando en este ámbito. El último modelo de Anthropic, que es Soneto de Claudio 3.7 , Él juega Pokémon Rojo en Twitch Ya ha estado disponible durante aproximadamente dos meses y ha hecho el mejor trabajo que un modelo de lenguaje grande (LLM) haya hecho jamás al reproducir Pokémon. Sin embargo, hay una pequeña salvedad: todavía está muy por detrás del nivel promedio de un niño humano de 10 años.

Un problema es la velocidad: Claude realiza miles de acciones a lo largo de varios días para hacer cosas como atravesar el Bosque Verde. Esto refleja los desafíos de la IA en el manejo de tareas complejas.

¿Por qué tarda tanto? No es que no pueda descubrir cómo ganar batallas Pokémon de forma estratégica; de hecho, esa es la parte en la que es bueno. Por otro lado, navegar por el entorno y evitar árboles y edificios no es tan bueno. Claude nunca ha sido entrenado para jugar Pokémon, y no le resulta fácil comprender el pixel art y lo que representa. Estas dificultades ponen de relieve la brecha existente entre la capacidad de procesar datos y la capacidad de interactuar con entornos complejos.

Pasar por zonas laberínticas como el Monte Luna es particularmente difícil para él, ya que lucha por formar un mapa del área y evitar ser rastreado. Una vez, se quedó tan atrapado en una esquina que concluyó que el juego estaba roto y emitió una solicitud oficial para reiniciarlo. Esto ilustra cómo la IA, a pesar de sus capacidades avanzadas, todavía carece de la comprensión intuitiva que poseen los humanos.

Estos primeros intentos también tuvieron sus momentos divertidos.

Una vez, Claude se quedó atrapado en un rincón y, convencido de que algo andaba mal, escribió una solicitud formal para reiniciar el juego. foto.twitter.com/5RIiCJdxCM— Antrópico (@AnthropicAI) Febrero 25, 2025

Tampoco es bueno para recordar sus objetivos, cosas que ya ha intentado o lugares que ha visitado antes.

Hay una razón muy sencilla para esto: los modelos de lenguaje grandes (LLM) tienen una ventana de contexto limitada que actúa como memoria. Solo pueden almacenar cierta cantidad de información, y una vez que Claude alcanza el límite, comprime lo que tiene para hacer espacio. Por lo tanto, información como "visité Ciudad Verde, entré en todos los edificios y hablé con todos los PNJ" podría comprimirse a solo "visité Ciudad Verde", lo que obligaría a Claude a revisar si hay algo que Plus pueda hacer en la ciudad.

En resumen: Claude no sabe hacia dónde va, se choca contra las paredes, se confunde con objetos aleatorios y NPC, olvida dónde ha estado y qué está tratando de hacer, y cada decisión que toma requiere párrafos y párrafos de pensamiento. Esto no es una crítica: son experimentos apasionantes que llevan los modelos de lenguaje grandes (LLM) hasta los límites de lo posible.

Pero con todo el revuelo en torno a la IA, es importante que la gente vea demostraciones como esta y forme sus propias opiniones sobre la IA. Algunas personas están tratando de vender la idea de que estamos a punto de alcanzar la inteligencia máxima, que dentro de unos años la inteligencia artificial (IA) superará incluso a los humanos más inteligentes, pero no creo que sean honestos, son solo vendedores. Aún estamos lejos de la cima, todo esto apenas está empezando.

Los comentarios están cerrados.