Secretos telefónicos que necesitan los entusiastas de la IA: cómo llevar Gemini y ChatGPT al máximo

Una de las tendencias más notables (y francamente, más aburridas) en la industria de los teléfonos inteligentes durante los últimos dos años ha sido la constante conversación sobre las experiencias de IA. Las empresas de silicio, en particular, suelen alardear de cómo sus últimos procesadores móviles permitirán operaciones de inteligencia artificial en el dispositivo, como la creación de vídeos.

Ya estamos ahí, aunque no del todo. En medio de todo el revuelo en torno a los trucos de inteligencia artificial que funcionan o no para los usuarios de teléfonos inteligentes, el debate rara vez va más allá de las llamativas presentaciones de nuevos procesadores y chatbots en constante evolución.

Fue solo cuando la ausencia de Gemini Nano del Google Pixel 8 causó sorpresa que el público se enteró de la importancia crítica de la capacidad de RAM para la IA en los dispositivos móviles. Apple también aclaró rápidamente que mantendría Apple Intelligence limitado a dispositivos con al menos 8 GB de RAM. Esta decisión refleja la importancia de la RAM para ejecutar modelos de IA de manera eficiente.

Pero la imagen de un “teléfono con IA” no solo tiene que ver con la capacidad de memoria. El rendimiento de su teléfono en las tareas impulsadas por IA también depende de optimizaciones invisibles de RAM, así como del almacenamiento. Y no, no estoy hablando sólo de capacidad.

Las innovaciones en memoria están llegando a los teléfonos con IA.

Digital Trends se reunió con Micron, líder mundial en soluciones de memoria y almacenamiento, para analizar el papel de la RAM y el almacenamiento en las operaciones de IA en los teléfonos inteligentes. Los avances de Micron deberían estar en tu radar la próxima vez que compres un teléfono premium.

Los últimos productos de la empresa con sede en Idaho incluyen almacenamiento móvil UFS 9 G4.1 NAND y módulos RAM LPDDR1X 1γ (5-gamma) para teléfonos inteligentes emblemáticos. Entonces, ¿cómo estas soluciones de memoria hacen avanzar la IA en los teléfonos inteligentes, además de aumentar la capacidad?

Comencemos con la solución de almacenamiento NAND UFS 9 del G4.1. La promesa principal es un consumo energético económico, una latencia reducida y un gran ancho de banda.. El estándar UFS 4.1 puede alcanzar velocidades máximas de lectura y escritura secuencial de 4100 MB/s, un aumento del 15 % respecto de la generación UFS 4.0 y al mismo tiempo reduce las cifras de latencia.

Otro beneficio crucial es que las unidades de almacenamiento portátiles de próxima generación de Micron están disponibles en capacidades de hasta 2 TB. Además, Micron ha podido reducir su tamaño, lo que lo convierte en una solución ideal para teléfonos plegables y teléfonos delgados de próxima generación como Samsung Galaxy S25 Edge.

Pasando a los avances de RAM, Micron ha desarrollado lo que llama módulos RAM 1γ LPDDR5X. Ofrece una velocidad máxima de 9200 MT/s, puede incluir un 30% más de transistores debido a su tamaño reducido y consume un 20% menos de energía al mismo tiempo. Micron ya ha presentado la solución de RAM 1β (1-beta) ligeramente más lenta que se encuentra dentro de la serie de teléfonos inteligentes Samsung Galaxy S25.

La interacción entre el almacenamiento y la inteligencia artificial

Ben Rivera, director de marketing de productos de la Unidad de Negocios Móviles de Micron, explicó que Micron ha introducido cuatro mejoras clave en sus últimas soluciones de almacenamiento para garantizar operaciones de IA más rápidas en dispositivos móviles. Estas mejoras incluyen UFS zonificado, desfragmentación de datos, Pinned WriteBooster y Intelligent Latency Tracker.

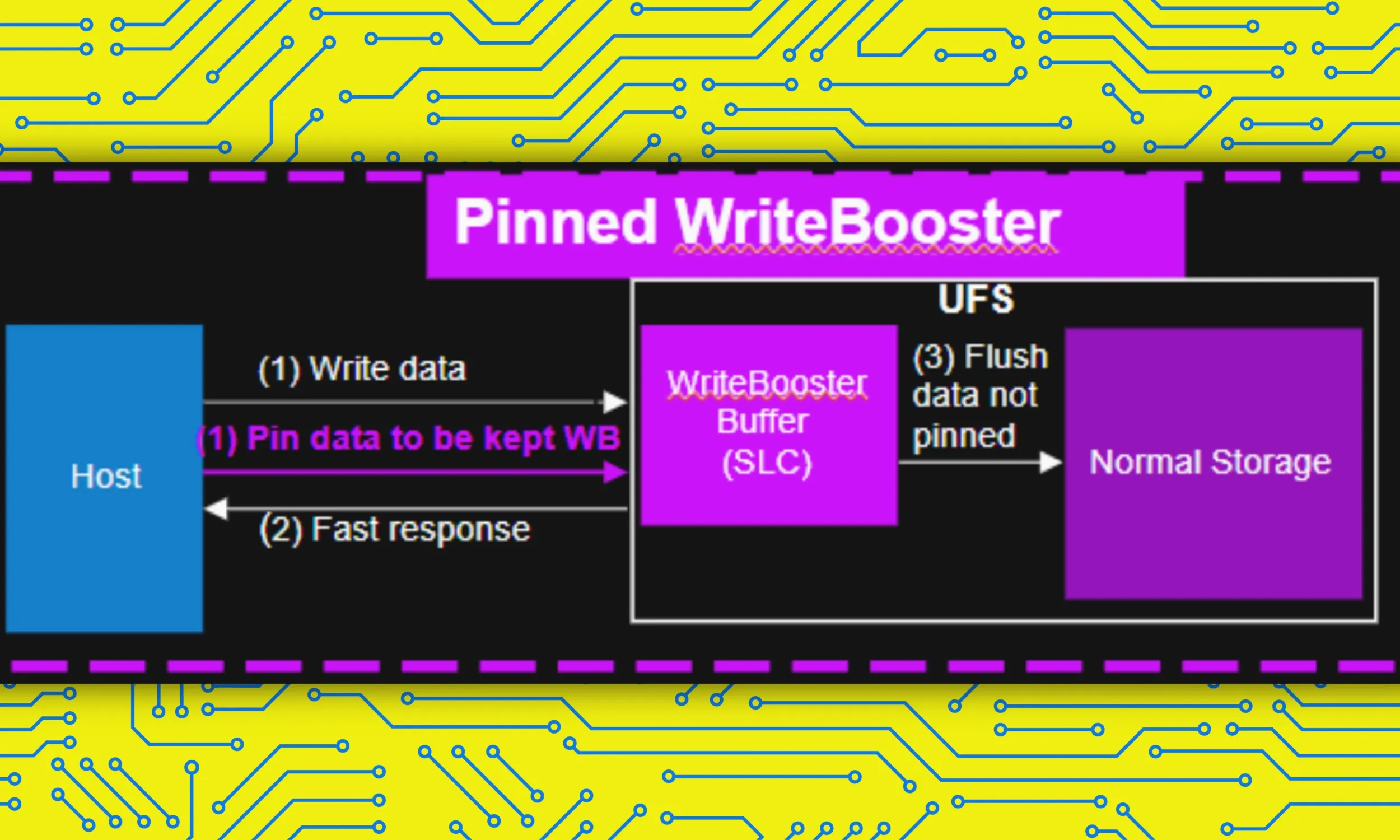

“Esta función permite al procesador o host identificar y aislar o 'anclar' los datos más utilizados en el teléfono inteligente a un área del dispositivo de almacenamiento llamada búfer WriteBooster (similar a un caché) para permitir un acceso rápido e inmediato a él”, explica Rivera sobre la función Pinned WriteBooster.

Cada modelo de IA (como Google Gemini o ChatGPT) que busca realizar tareas en un dispositivo necesita su propio conjunto de archivos de instrucciones almacenados localmente en el dispositivo móvil. Por ejemplo, necesitas Apple Intelligence hasta 7 GB de espacio de almacenamiento Para todas sus operaciones.

Para realizar una tarea, no puedes delegar toda la pila de IA a la RAM, ya que necesitará espacio para procesar otras tareas importantes, como realizar llamadas o interactuar con otras aplicaciones importantes. Para abordar las limitaciones del almacenamiento de Micron, se crea un mapa de memoria que solo carga los pesos de IA necesarios desde el almacenamiento a la RAM.

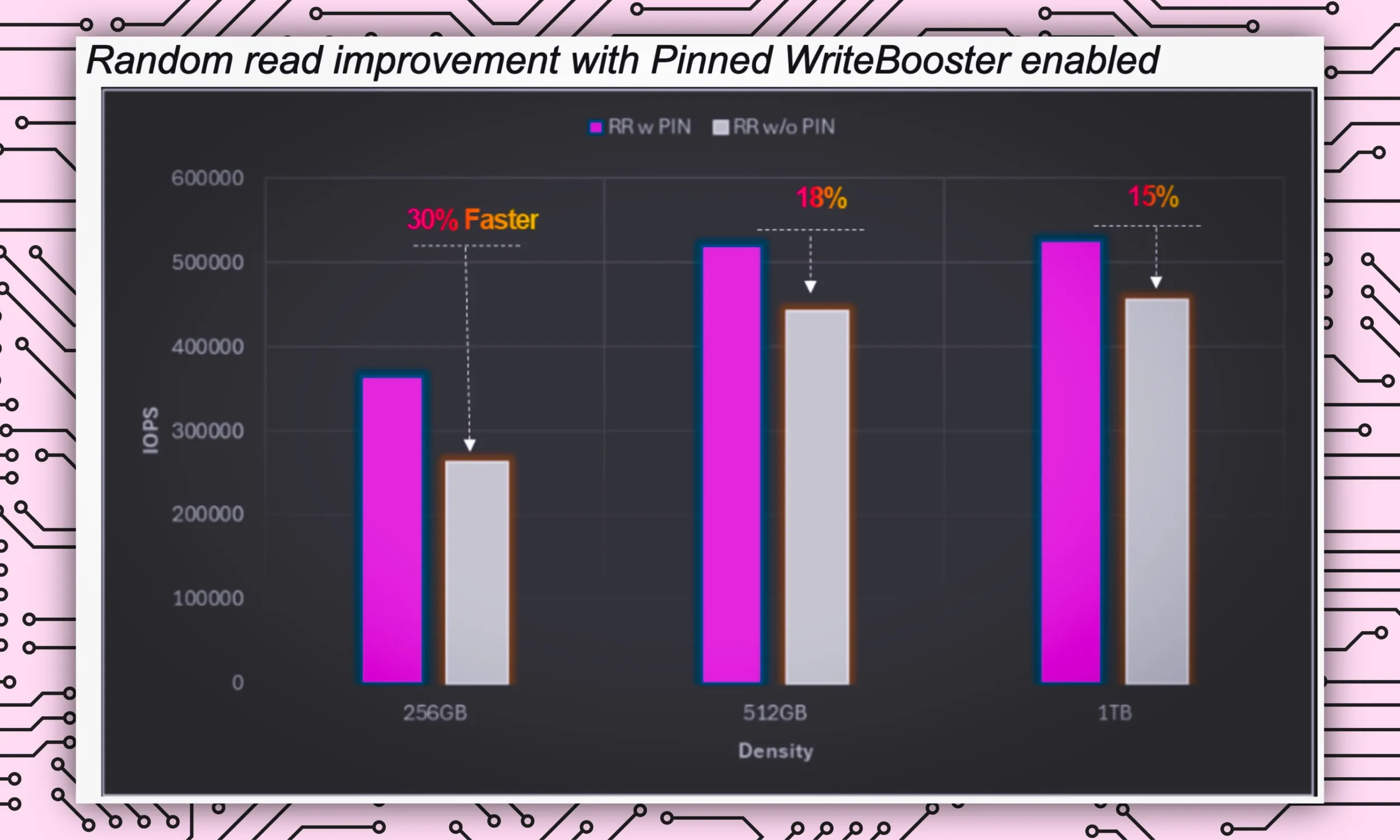

Cuando los recursos se vuelven limitados, lo que se necesita es un intercambio y una lectura de datos más rápidos. Hacer esto garantiza que sus tareas de IA se ejecuten sin afectar la velocidad de otras tareas importantes. Gracias a Pinned WriteBooster, este intercambio de datos se acelera en un 30%, lo que garantiza que las tareas de IA se procesen sin retrasos.

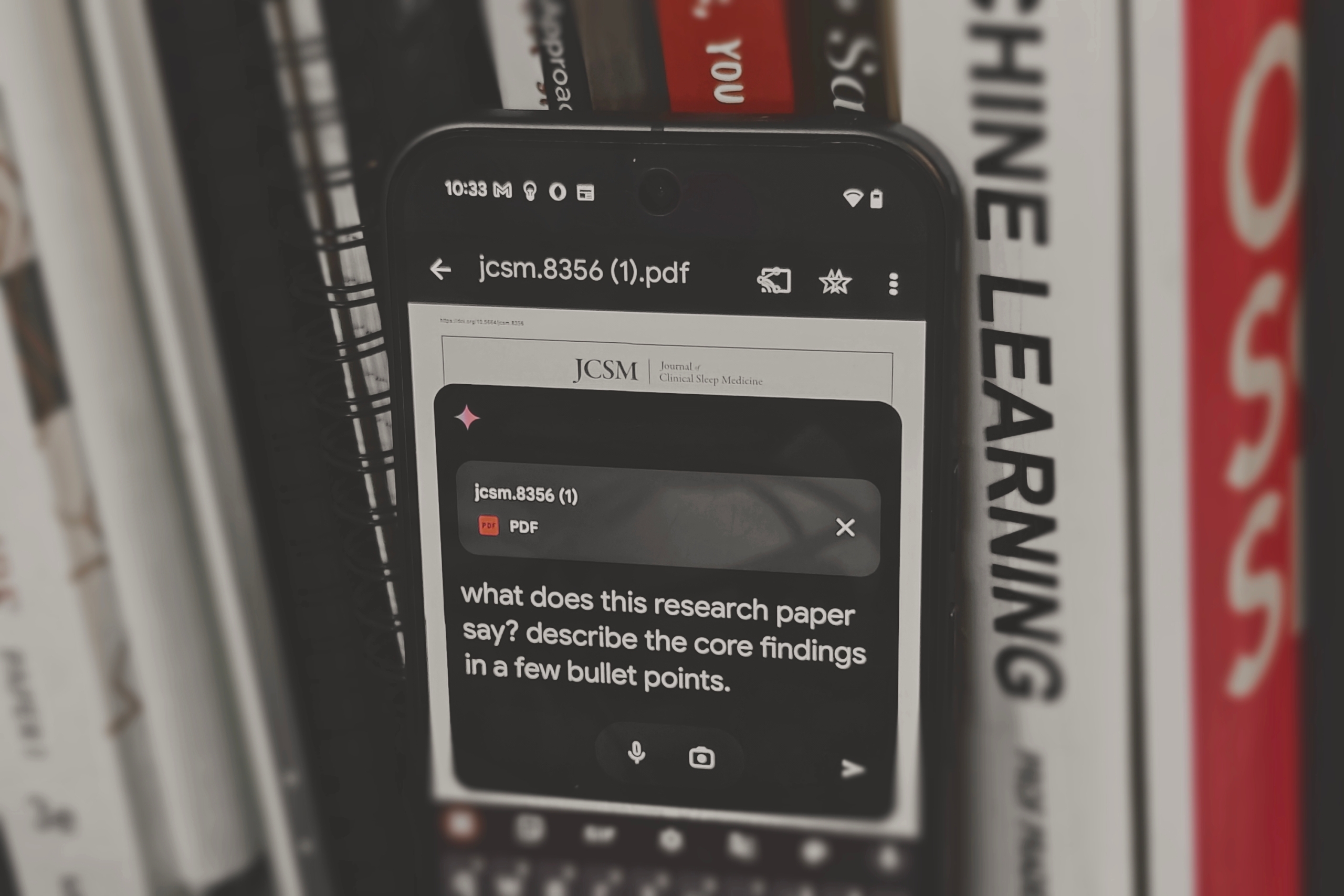

Supongamos que necesitas Gemini extraerá archivos PDF para su análisis. El intercambio rápido de memoria garantiza que los pesos de IA requeridos se transfieran rápidamente del almacenamiento a la RAM.

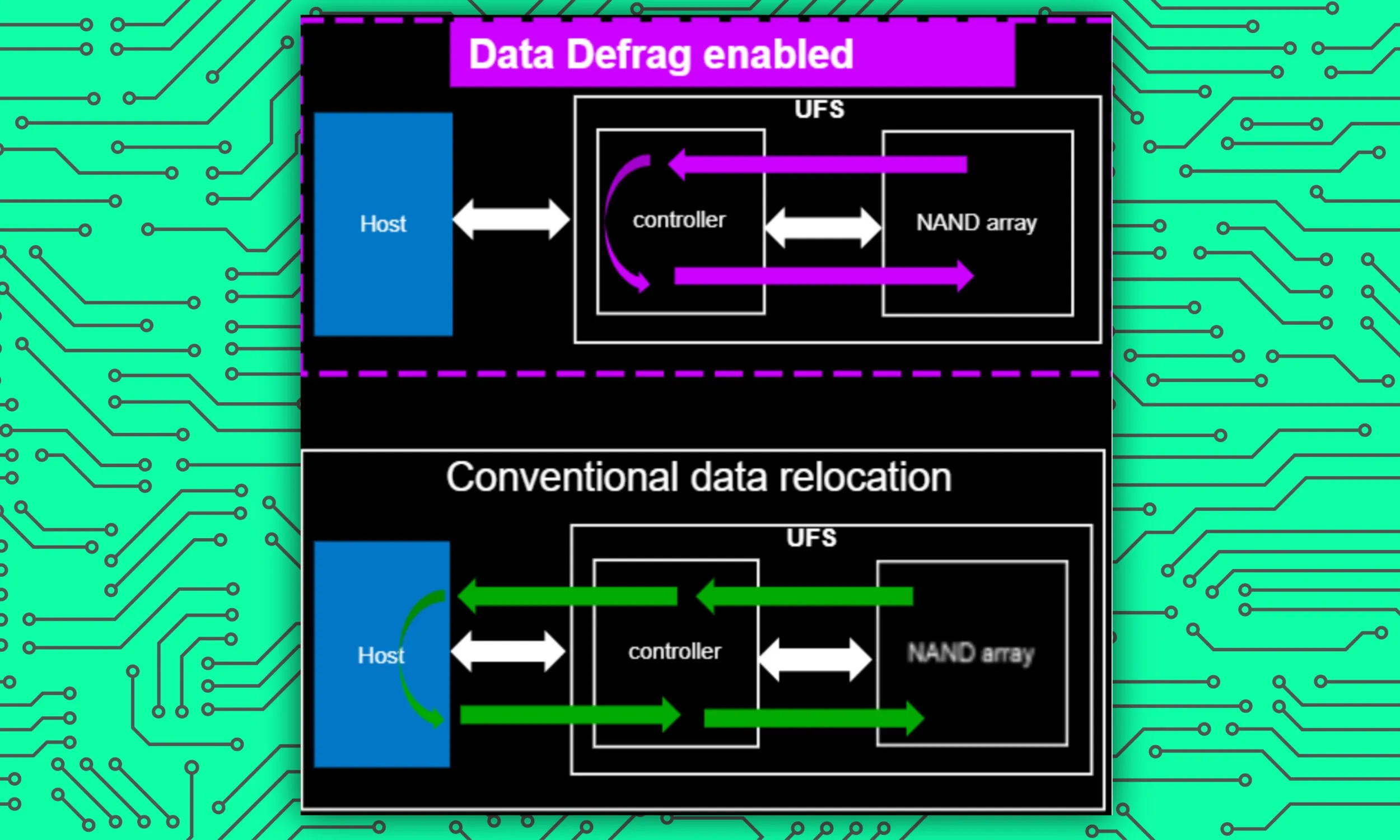

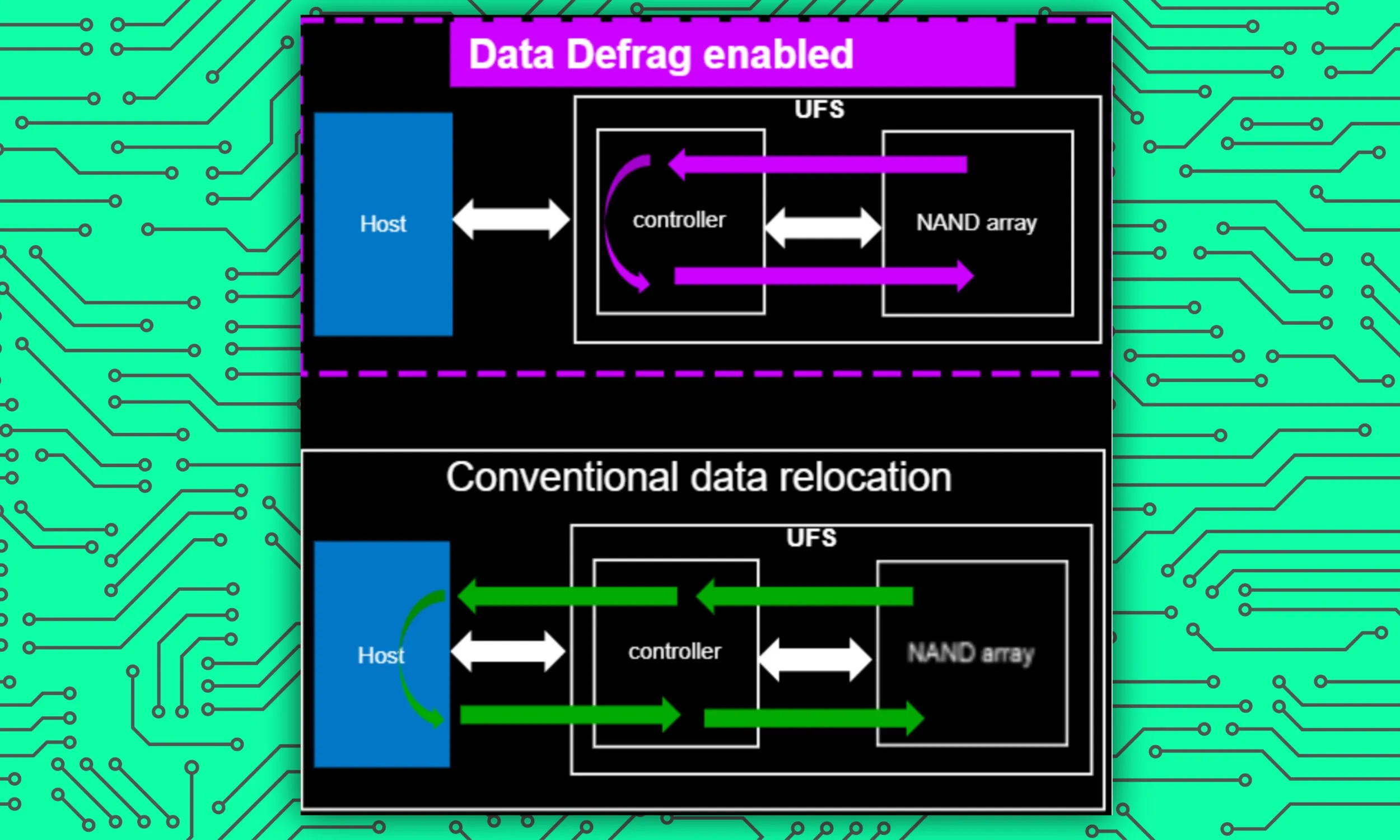

A continuación tenemos Data Defrag. Piense en ello como un organizador de escritorio o de armario, asegurándose de que los objetos estén perfectamente agrupados en diferentes categorías y colocados en sus gabinetes únicos para que sean fáciles de encontrar.

En el contexto de los teléfonos inteligentes, si bien se almacena una gran cantidad de datos durante un largo periodo de uso, estos suelen almacenarse de forma algo aleatoria. El resultado es que, cuando el sistema integrado necesita acceder a un tipo específico de archivo, resulta más difícil encontrarlos todos, lo que resulta en un funcionamiento más lento.

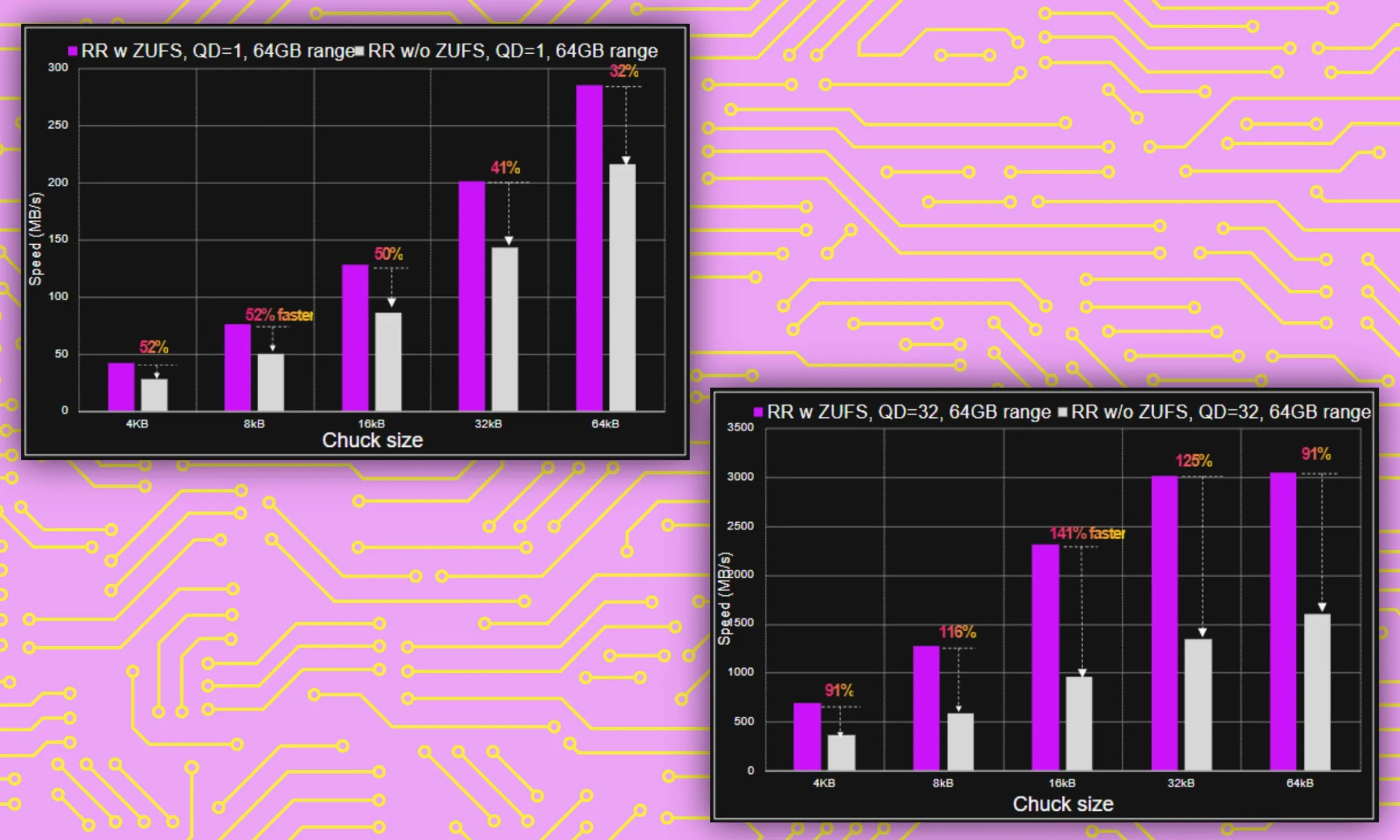

Según Rivera, Data Defrag no sólo ayuda con el almacenamiento organizado de datos, sino que también cambia la forma en que el dispositivo de almacenamiento interactúa con el controlador del dispositivo. Por lo tanto, es Aumenta la velocidad de lectura de datos en un asombroso 60%, acelerando naturalmente todo tipo de interacciones usuario-dispositivo, incluidas las tareas de IA.

“Esta función puede ayudar a acelerar las funciones de IA, como cuando un modelo de IA generativo, como el que se usa para generar una imagen a partir de una solicitud de texto, se llama del almacenamiento a la memoria, lo que permite que los datos se lean más rápido del almacenamiento a la memoria”, dijo un funcionario de Micron a Digital Trends.

Intelligence Latency Tracker es otra función que básicamente monitorea eventos de latencia y factores que podrían ralentizar el ritmo habitual de tu teléfono. Posteriormente, ayuda a corregir errores y mejorar el rendimiento del teléfono para garantizar que las tareas normales, así como las tareas de IA, no encuentren obstáculos.

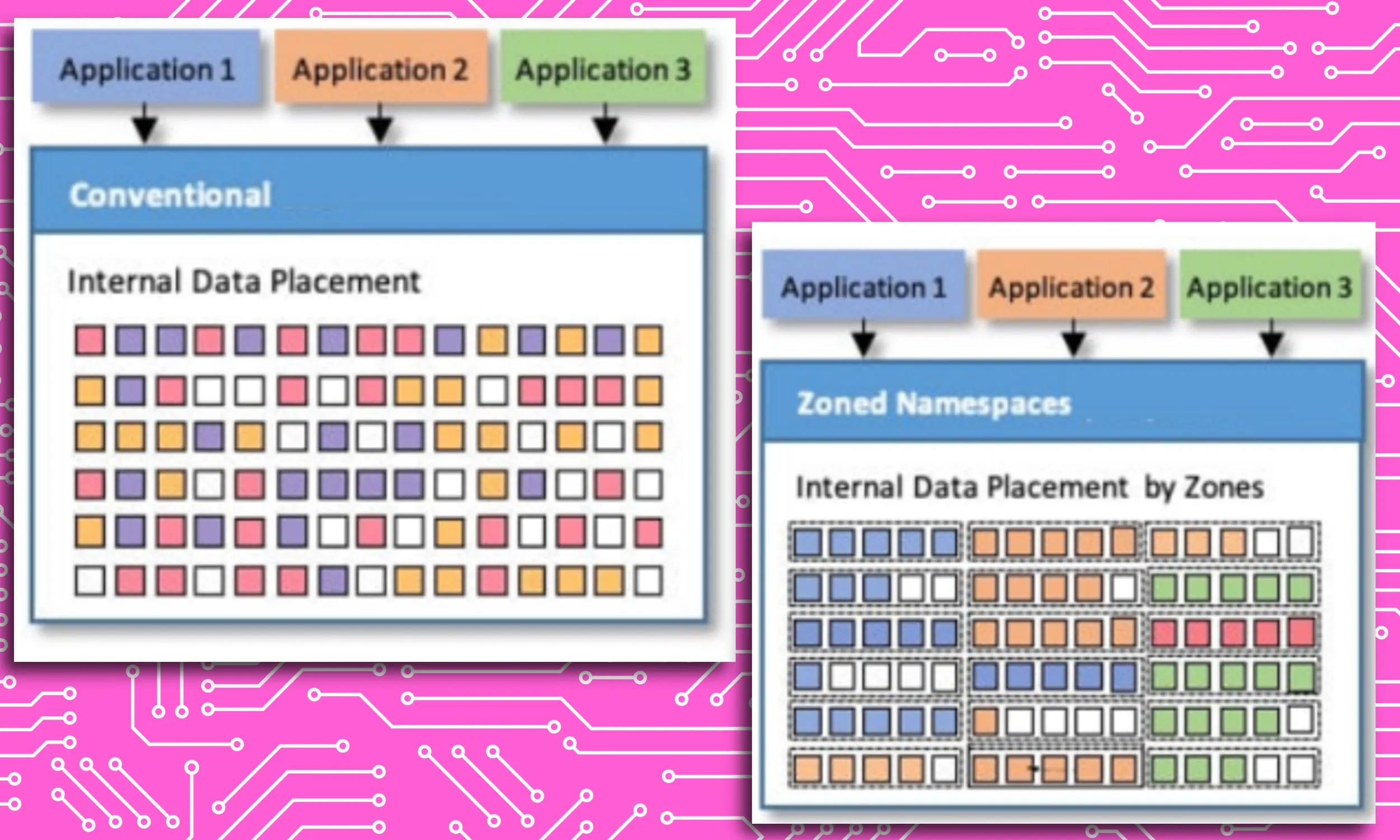

La última mejora del almacenamiento es el UFS zonificado. Este sistema garantiza que los datos de naturaleza de entrada/salida similar se almacenen de manera organizada. Esto es muy importante porque facilita que el sistema localice los archivos necesarios, en lugar de perder tiempo buscando en todas las carpetas y directorios.

“La función ZUFS de Micron ayuda a organizar los datos para que cuando el sistema necesite localizar datos específicos para una tarea, el proceso sea más rápido y fluido”, nos dijo Rivera.

Desbordamiento de RAM

Cuando se trata de flujos de trabajo de IA, se necesita una cierta cantidad de RAM. Cuanto más capacidad, mejor. Si bien Apple ha establecido la base en 8 GB para su suite Apple Intelligence, los actores del ecosistema Android han pasado a 12 GB como valor predeterminado seguro. ¿por qué?

“Las experiencias de IA también consumen muchos datos y energía”, explica Rivera. “Por lo tanto, para cumplir la promesa de la IA, la memoria y el almacenamiento deben ofrecer baja latencia y alto rendimiento con la máxima eficiencia energética”.

Con su solución DRAM LPDDR5X 1γ (1-gamma) de próxima generación para teléfonos inteligentes, Micron ha podido reducir el voltaje operativo de los módulos de memoria. Luego está la importantísima cuestión del rendimiento local. Rivera dice que los nuevos módulos de memoria pueden operar a velocidades de hasta 9.6 gigabits por segundo, lo que garantiza un rendimiento de IA excepcional.

Micron afirma que las mejoras en su proceso de litografía ultravioleta extrema (EUV) han abierto la puerta no sólo a velocidades más altas, sino también a un saludable salto del 20% en la eficiencia energética.

¿El camino hacia experiencias de IA más personalizadas?

Las soluciones de almacenamiento y RAM de próxima generación de Micron para teléfonos inteligentes apuntan no solo a un mejor rendimiento de la IA, sino también a la aceleración general de las tareas cotidianas de sus teléfonos inteligentes. Me pregunté si el almacenamiento móvil NAND UFS 9 mejorado del G4.1 y la RAM LPDDR1X 1γ (5-gamma) también acelerarían los procesadores de IA fuera de línea.

Los fabricantes de teléfonos inteligentes y los laboratorios de inteligencia artificial están avanzando cada vez más hacia el procesamiento de inteligencia artificial local. Esto significa que en lugar de enviar sus consultas a un servidor en la nube donde se procesa el proceso y luego se envía el resultado a su teléfono mediante una conexión a Internet, todo el flujo de trabajo se ejecuta localmente en su teléfono.

Desde la transcripción de llamadas y notas de voz hasta el procesamiento de materiales de investigación complejos en archivos PDF, todo sucede en tu teléfono y ningún dato personal sale jamás de tu dispositivo. También es un enfoque más seguro y rápido, pero al mismo tiempo requiere potentes recursos del sistema. Un módulo de memoria más rápido y eficiente es uno de estos requisitos esenciales.

¿Pueden las soluciones de próxima generación de Micron ayudar a abordar la IA a nivel local? Ella puede. De hecho, también acelerará procesos que requieren una conexión a la nube, como la creación de vídeos utilizando el modelo Veo de Google, que todavía requiere servidores informáticos potentes.

“Una aplicación de IA nativa que se ejecuta directamente en el dispositivo tendrá la mayor cantidad de tráfico porque no solo lee datos del usuario desde el dispositivo de almacenamiento, sino que también realiza inferencias de IA en el dispositivo”, afirma Rivera. “En este caso, nuestras funciones ayudarán a optimizar el flujo de datos para ambos”.

Entonces, ¿cuándo podemos esperar que los teléfonos equipados con las últimas soluciones de Micron lleguen a los mercados? Rivera dice que todos los principales fabricantes de teléfonos inteligentes adoptarán los módulos de almacenamiento y RAM de próxima generación de Micron. En términos de acceso al mercado, “los modelos principales que se lanzarán a fines de 2025 o principios de 2026” deberían estar en su radar de compras.

Los comentarios están cerrados.