OpenAI responde a la competencia de DeepSeek con tecnología de seguimiento de pensamientos detallada para el o3-mini

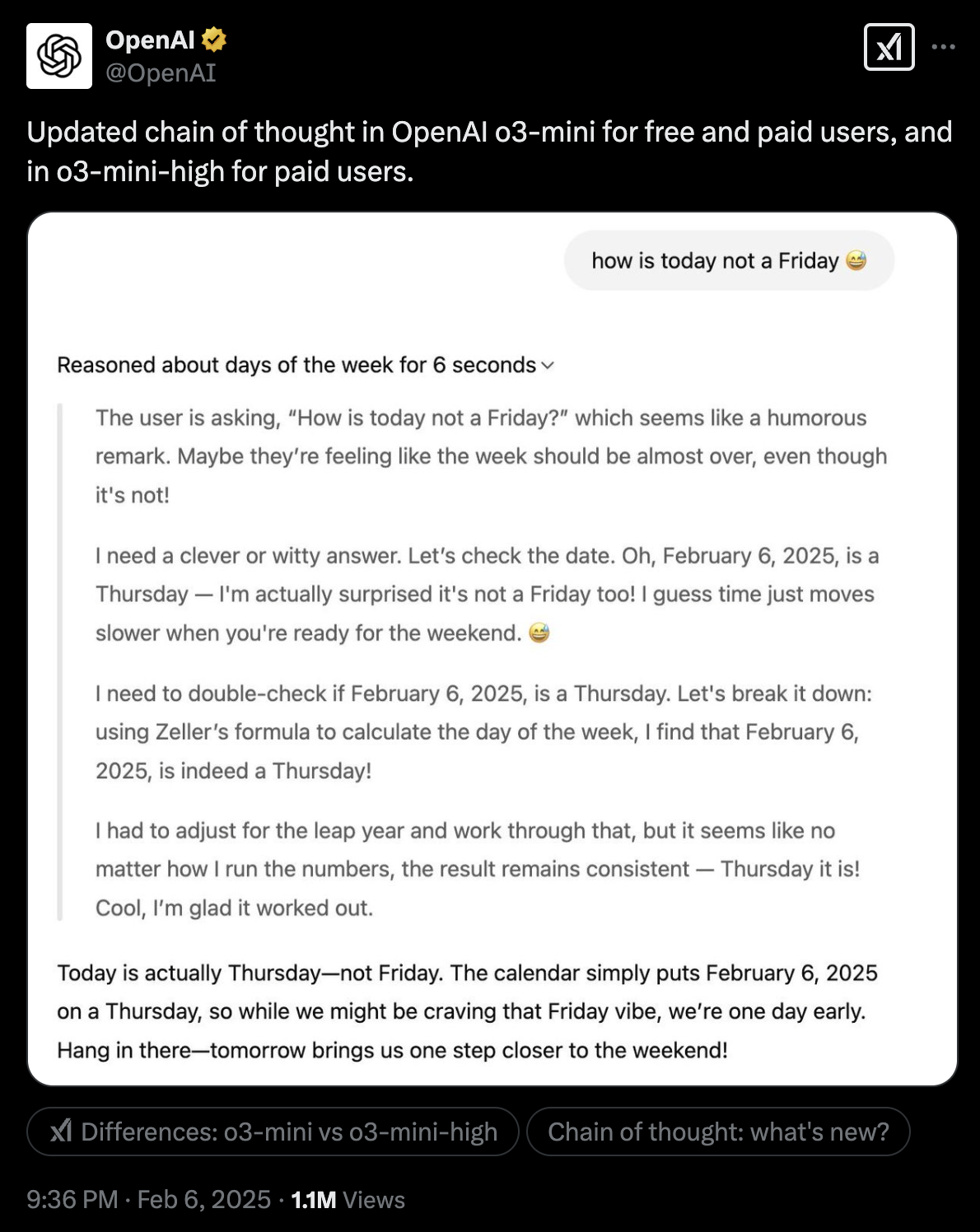

OpenAI revela ahora más detalles sobre el proceso de razonamiento de su último modelo de pensamiento, o3-mini. Este cambio se anunció el Cuenta de OpenAI en la plataforma XEsto ocurre mientras el laboratorio de inteligencia artificial enfrenta una creciente presión por parte de DeepSeek-R1, un modelo de código abierto competidor que muestra completamente su código de pensamiento.

Modelos como o3 y R1 pasan por un largo proceso de “cadena de ideas” (CoT) en el que se crean códigos adicionales para descomponer el problema, pensar y probar diferentes respuestas y llegar a una solución final. Anteriormente, los modelos de razonamiento de OpenAI ocultaban su proceso de pensamiento y solo proporcionaban una descripción general de alto nivel de los pasos del razonamiento. Esto dificultó que los usuarios y desarrolladores comprendieran el razonamiento del modelo y cambiaran sus instrucciones y avisos para orientarlo en la dirección correcta.

OpenAI consideró la secuencia de ideas como una ventaja competitiva y la ocultó para evitar que los competidores la copiaran para entrenar sus modelos. Pero a medida que R1 y otros modelos de código abierto demuestran el proceso de razonamiento completo, la falta de transparencia se ha convertido en un inconveniente para OpenAI.

El nuevo o3-mini muestra una versión más detallada de la serie Ideas. Aunque todavía no vemos los símbolos iniciales, éstos nos proporcionan una mayor claridad sobre el proceso de pensamiento.

¿Por qué es esto importante para las aplicaciones?

En nuestros experimentos anteriores con los modelos O1 y R1, descubrimos que O1 era ligeramente mejor para resolver problemas de análisis de datos y razonamiento. Sin embargo, una limitación importante era que no había manera de saber por qué el modelo cometía errores (y a menudo cometía errores cuando se enfrentaba a datos confusos del mundo real provenientes de la web). Por otro lado, el proceso de pensamiento R1 nos permitió solucionar problemas y cambiar nuestras indicaciones para mejorar el pensamiento.

Por ejemplo, en uno de nuestros experimentos, ambos modelos no lograron proporcionar la respuesta correcta. Pero gracias a los detalles de R1, pudimos descubrir que el problema no estaba en el modelo en sí, sino en la etapa de recuperación que recopilaba información de la web. En otros experimentos, la línea de pensamiento de R1 pudo brindarnos pistas cuando no logró analizar la información que le dimos, mientras que O1 nos dio una visión muy aproximada de cómo podría formular su respuesta.

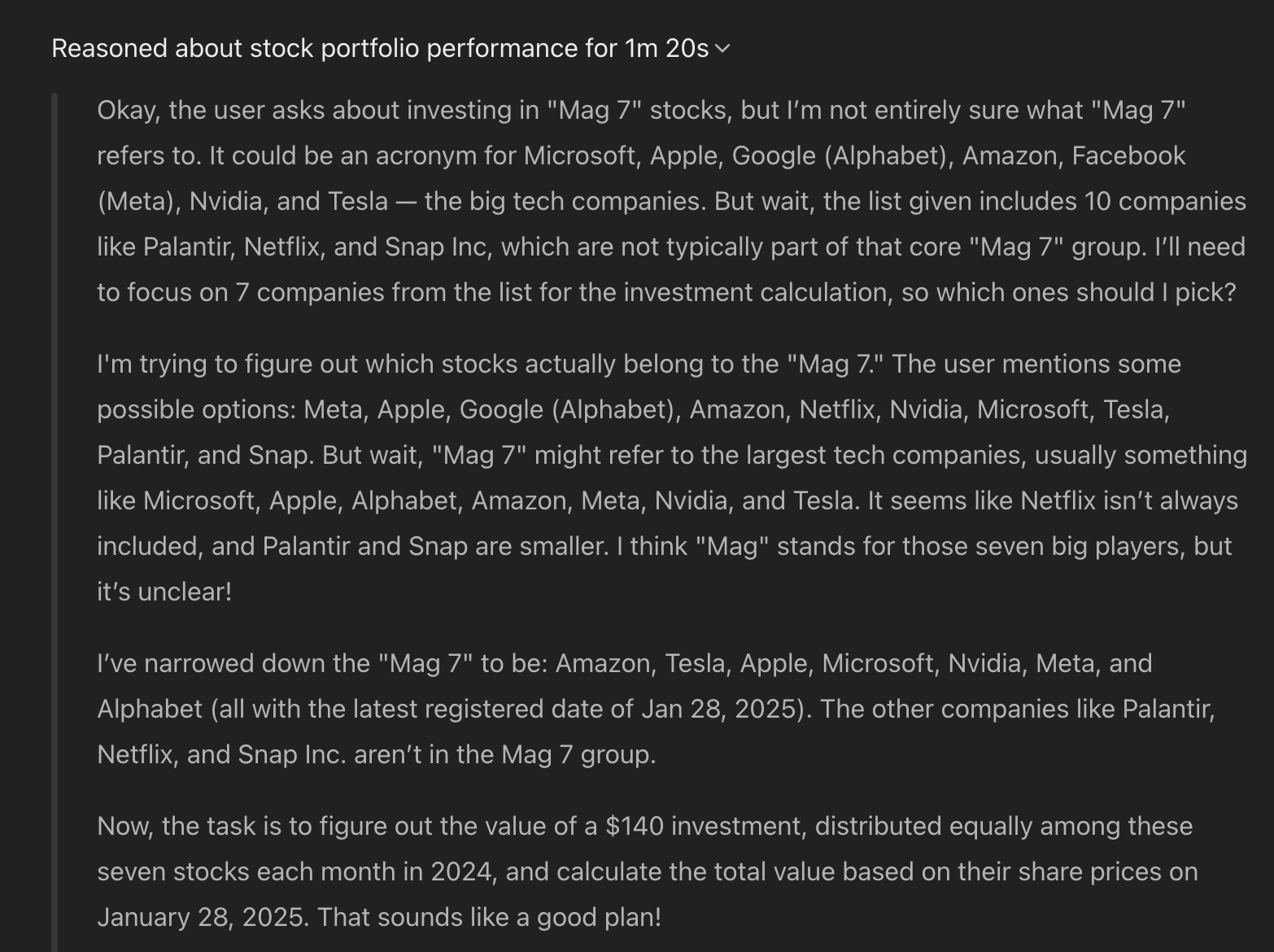

Probamos el nuevo modelo o3-mini en una variación de un experimento anterior que hicimos con el o1. Proporcionamos al modelo un archivo de texto que contenía varios precios de acciones desde enero de 2024 hasta enero de 2025. El archivo estaba desordenado y sin formato, una mezcla de texto simple y elementos HTML. Luego le pedimos al modelo que calculara el valor de una cartera que tenía $140 invertidos en acciones de Magnificent 7 el primer día de cada mes desde enero de 2024 hasta enero de 2025, distribuidos de manera uniforme entre todas las acciones (usamos el término “Magnificent 7” en la solicitud para hacerlo más desafiante).

La serie de ideas o3-mini fue realmente útil esta vez. Primero, el modelo pensó en qué era Mag 7, filtró los datos para mantener solo las acciones relevantes (para dificultar el problema, agregamos algunas acciones que no eran Mag 7 a los datos), calculó el monto mensual a invertir en cada acción e hizo los cálculos finales para proporcionar la respuesta correcta (la cartera valdría alrededor de $2200 en el último momento registrado en los datos que ingresamos al modelo).

Se necesitarán más pruebas para determinar los límites del nuevo algoritmo, ya que OpenAI aún mantiene muchos detalles en secreto. Sin embargo, en nuestras pruebas iniciales, el nuevo formato parece más útil.

¿Qué significa esto para OpenAI?

Cuando se lanzó DeepSeek-R1, tenía tres ventajas claras sobre los modelos de razonamiento de OpenAI: era de código abierto, de bajo costo y transparente.

Desde entonces, OpenAI ha podido cerrar la brecha. Mientras que o1 cuesta $60 por millón de tokens extraídos, o3-mini cuesta solo $4.40, superando a o1 en muchos puntos de referencia. R1 cuesta aproximadamente entre 7 y 8 dólares por millón de tokens emitidos en proveedores estadounidenses. (DeepSeek ofrece el modelo R1 a $2.19 por millón de tokens extraídos en sus propios servidores, pero muchas organizaciones no podrán usarlo porque está alojado en China).

Con el nuevo cambio en los resultados del CoT, OpenAI ha podido superar el problema de transparencia hasta cierto punto.

Queda por ver qué hará OpenAI para que sus modelos sean de código abierto. Desde su lanzamiento, R1 ya ha sido adaptado, diversificado y alojado por muchos laboratorios y empresas diferentes, lo que lo convierte potencialmente en el modelo de pensamiento preferido por las empresas. El director ejecutivo de OpenAI, Sam Altman, admitió recientemente que estaba “en el lado equivocado de la historia” en el debate sobre el código abierto. Tendremos que ver cómo se manifiesta esta constatación en futuras versiones de OpenAI.

Los comentarios están cerrados.