Google lanza Gemini 2.0 Pro y Flash-Lite, conectando Flash Thinking con YouTube, Maps y Search

La serie Gemini de modelos de lenguaje grandes (LLM) de Google tuvo un comienzo difícil hace casi un año con algunas imágenes mal generadas y vergonzosas, pero han mejorado constantemente desde entonces y la compañía parece decidida a hacer que su esfuerzo de segunda generación (Gemini 2.0) sea el más grande y mejor hasta ahora para consumidores y empresas.

اليوم ، Anunciado La compañía anunció el lanzamiento público de Gemini 2.0 Flash, presentó Gemini 2.0 Flash-Lite y lanzó una versión beta de Gemini 2.0 Pro.

Estos modelos, diseñados para apoyar a desarrolladores y empresas, ahora están disponibles a través de Google AI Studio y Vertex AI, con Flash-Lite disponible en vista previa pública y Pro disponible para pruebas tempranas.

“Todos estos modelos contarán con entrada multimedia con salida de texto en el lanzamiento, con Plus media disponible para uso general en los próximos meses”, escribió Koray Cavukcioglu, director de tecnología de Google DeepMind, en la publicación del blog de la compañía que anunció el anuncio, lo que muestra una ventaja que Google está poniendo sobre la mesa incluso cuando competidores como búsqueda profundayOpenAI En el lanzamiento de fuertes competidores.

Google aprovecha sus capacidades multimedia

Ni el DeepSeek-R1 ni El nuevo modelo o3-mini de OpenAI Acepte entradas multimedia, es decir, imágenes, archivos cargados o adjuntos.

Si bien el modelo R1 puede aceptarlos en su sitio web y su aplicación de chat móvil, utiliza reconocimiento óptico de caracteres (OCR), una tecnología que tiene más de 60 años de antigüedad, para extraer solo el texto de estas cargas y no entiende ni analiza ninguna de las otras características en ellas.

Sin embargo, ambos representan una nueva clase de modelos de “pensamiento” que deliberadamente toman más tiempo para pensar las respuestas y reflexionar sobre las “cadenas de pensamiento” y la validez de sus respuestas. Esto contrasta con los modelos de lenguaje grandes típicos como la serie Gemini 2.0 pro, por lo que comparar Gemini 2.0 con DeepSeek-R1 y OpenAI o3 es como comparar manzanas con naranjas.

Pero también hubo algunas noticias del lado pensante de Google hoy: el CEO de Google, Sundar Pichai, anunció a través de Plataforma X Acerca de la actualización de la aplicación Google Géminis Para teléfonos móviles iOS y Android con Gemini 2.0 Flash Thinking. El modelo se puede conectar a Google Maps, YouTube y Google Search, lo que permite un nuevo conjunto de búsquedas e interacciones impulsadas por IA que sus nuevos competidores sin estos servicios, como DeepSeek y OpenAI, no pueden igualar.

Lo probé brevemente en la aplicación iOS de Google Gemini en mi iPhone mientras escribía este artículo y fue impresionante en función de mis consultas iniciales, encontrando similitudes entre los 10 videos más vistos de YouTube del mes pasado y dándome una lista de consultorios médicos cercanos y sus horarios de apertura y cierre, todo en segundos.

Versión pública de Gemini 2.0 Flash

El modelo Gemini 2.0 Flash, lanzado inicialmente como una versión beta, se ha convertido en En diciembre, listo para producción ahora.

Diseñado para aplicaciones de IA altamente eficientes, ofrece respuestas de baja latencia y admite el razonamiento multimodal a gran escala.

Una de sus principales ventajas sobre la competencia es su ventana de contexto, o la cantidad de tokens que un usuario puede agregar como incentivo y recibir a cambio en una única interacción de ida y vuelta con un chatbot o API impulsado por LLM.

Si bien muchos modelos líderes, como el nuevo o3-mini de OpenAI que debutó la semana pasada, admiten 200000 tokens o menos (el equivalente a una novela de 400 a 500 páginas), Gemini 2.0 Flash admite XNUMX millón de tokens, lo que significa que puede manejar cantidades masivas de información, lo que lo hace particularmente útil para tareas de gran escala y alta frecuencia.

Gemini 2.0 Flash-Lite: Soluciones de IA de bajo costo

Gemini 2.0 Flash-Lite es un nuevo modelo de lenguaje de gran tamaño que tiene como objetivo proporcionar soluciones de IA rentables sin comprometer la calidad.

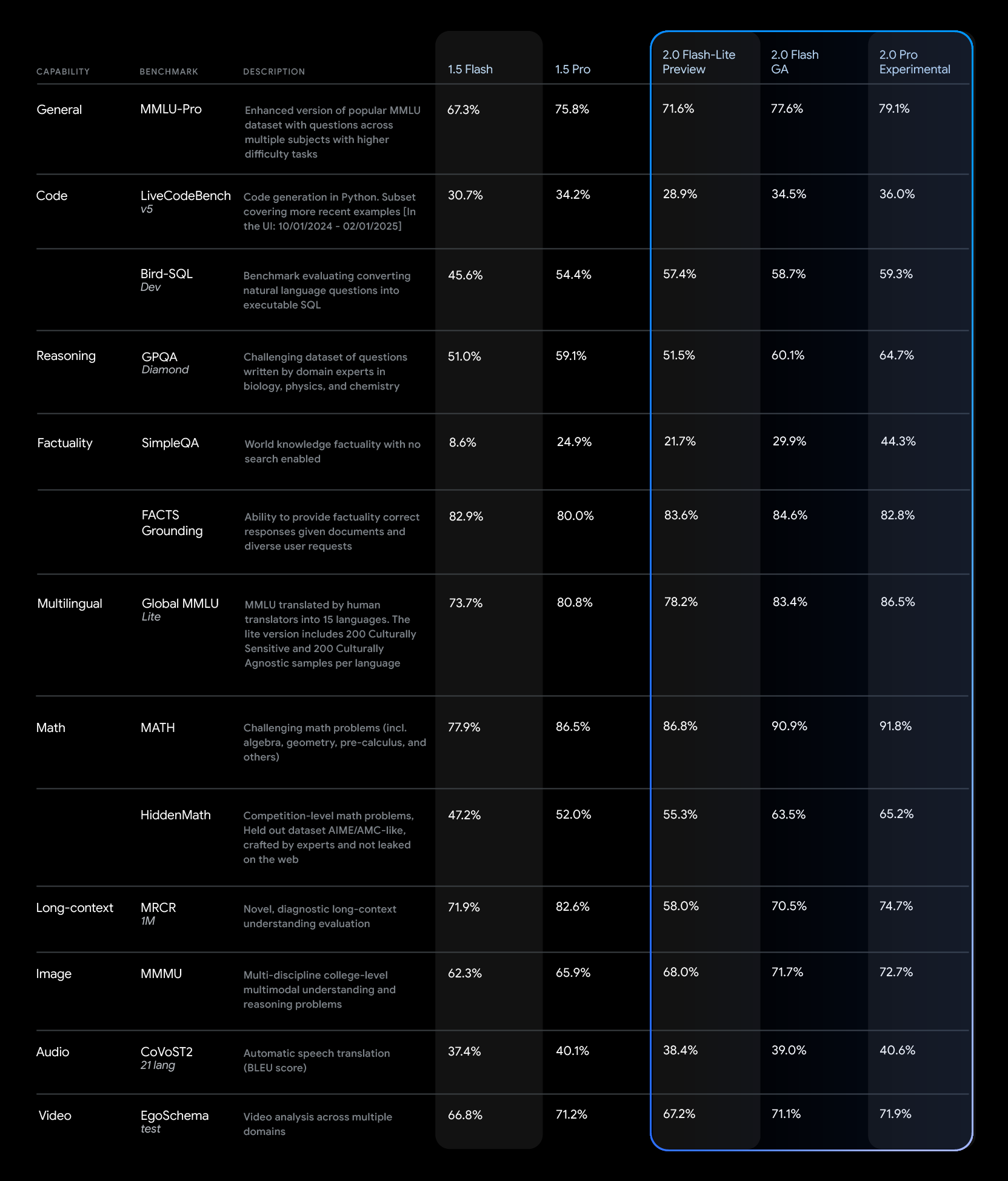

Google DeepMind informa que Flash-Lite supera a su predecesor de tamaño completo (más parametrizado), Gemini 1.5 Flash, en puntos de referencia externos como MMLU Pro (77.6% frente a 67.3%) y Bird SQL (57.4% frente a 45.6%), manteniendo al mismo tiempo el mismo precio y velocidad.

También admite entrada multimedia y cuenta con una ventana de contexto de 1 millón de tokens, similar al modelo Flash completo.

Flash-Lite está actualmente disponible en versión preliminar pública a través de Google AI Studio y Vertex AI, y se espera que esté disponible de forma general en las próximas semanas.

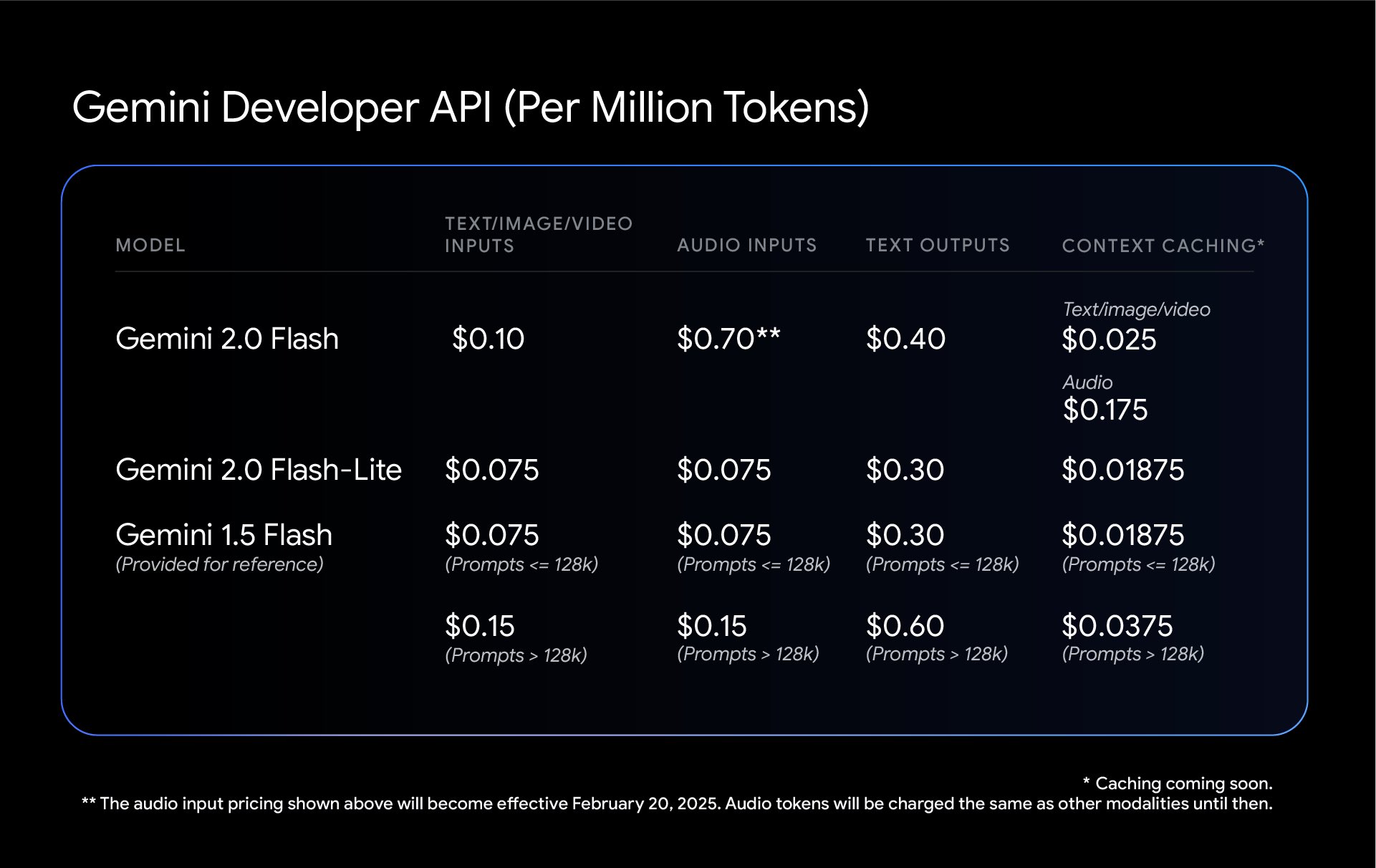

Como se muestra en la siguiente tabla, Gemini 2.0 Flash-Lite tiene un precio de $0.075 por millón de tokens (entrada) y $0.30 por millón de tokens (salida). Flash-Lite es una opción muy asequible para los desarrolladores, que supera a Gemini 1.5 Flash en la mayoría de los puntos de referencia y mantiene la misma estructura de costos.

Logan Kilpatrick destacó el costo y el valor de los modelos Gemini 2.0 Flash, como Hombre en la plataforma X“El Gemini 2.0 Flash ofrece la mejor relación calidad-precio entre todos los modelos LLM. ¡Es hora de empezar a construir!”

De hecho, en comparación con otros modelos LLM tradicionales líderes disponibles a través de la API del proveedor, como OpenAI 4o-mini ($0.15/$0.6 por millón de tokens de E/S), y Claude antrópico ($0.8/$4! por millón de tokens de E/S) e incluso el tradicional LLM V3 de DeepSeek ($0.14/$0.28), Gemini 2.0 Flash parece ser la mejor relación precio-calidad.

Gemini 2.0 Pro Beta llega con 2 millones de iconos en la ventana contextual

El modelo Gemini 2.0 Pro (beta) ya está disponible para pruebas, para usuarios que necesitan capacidades de IA más avanzadas.

Google DeepMind describe este modelo como su modelo más poderoso para el rendimiento de programación y la capacidad de manejar indicaciones complejas. Cuenta con una ventana de contexto de 2 millones de caracteres y capacidades de razonamiento mejoradas, con la capacidad de integrar herramientas externas como Google Search y ejecución de código.

Sam Witteveen, cofundador y director ejecutivo de Red Dragon AI y experto externo en desarrollo de aprendizaje automático en Google que colabora a menudo con VentureBeat, analizó: Modelo profesional en reseña de YouTube. “El nuevo modelo Gemini 2.0 Pro tiene una ventana contextual con 1.5 millones de íconos, admite widgets, ejecución de código, llamadas de funciones e integración con la Búsqueda de Google: todo lo que teníamos en Pro XNUMX, pero mejorado”.

También destacó el enfoque iterativo de Google para el desarrollo de IA: “Una diferencia clave en la estrategia de Google es que lanza versiones beta de los modelos antes de que estén disponibles para el público general (GA), lo que permite una iteración rápida basada en la retroalimentación”.

Los puntos de referencia de rendimiento demuestran aún más las capacidades de la familia de modelos Gemini 2.0. Por ejemplo, Gemini 2.0 Pro supera a Flash y Flash-Lite en tareas como razonamiento, comprensión multilingüe y procesamiento de contexto largo.

Seguridad de la IA y desarrollos futuros

Seguridad de la IA y desarrollos futuros

Junto con estas actualizaciones, Google DeepMind está implementando nuevas medidas de seguridad para sus modelos Gemini 2.0. La empresa aprovecha técnicas de aprendizaje de refuerzo para mejorar la precisión de la respuesta, utilizando inteligencia artificial para criticar y mejorar sus resultados. Además, se utilizan pruebas de seguridad automatizadas para identificar vulnerabilidades, incluidas amenazas de inyección de reclamaciones indirectas.

De cara al futuro, Google DeepMind planea ampliar las capacidades de la familia de modelos Gemini 2.0, y se espera que métodos adicionales más allá del texto estén disponibles para el público general en los próximos meses.

Con estas actualizaciones, Google está fortaleciendo su impulso en el desarrollo de IA, presentando un conjunto de modelos diseñados para la eficiencia, la asequibilidad y la resolución avanzada de problemas, respondiendo al auge de DeepSeek con su propio conjunto de modelos que van desde potentes a muy potentes y muy asequibles a ligeramente menos costosos (pero aún asequibles).

¿Será esto suficiente para ayudar a Google a entrar en el mercado de la IA empresarial, que antes estaba dominado por OpenAI y ahora está dominado por DeepSeek? ¡Seguiremos haciendo seguimiento y te informaremos!

Si quieres impresionar a tu jefe, VB Daily te ayudará. Le brindamos información exclusiva sobre lo que las empresas están haciendo con la IA generativa, desde transformaciones organizacionales hasta implementaciones prácticas, para que pueda compartir conocimientos y maximizar su ROI.

Seguridad de la IA y desarrollos futuros

Seguridad de la IA y desarrollos futuros

Los comentarios están cerrados.