Cómo la IA está reescribiendo las tareas diarias de los científicos de datos

Desde la eliminación de tareas de bajo valor hasta la aceleración de proyectos de alto impacto, así es como la IA está transformando los flujos de trabajo de la ciencia de datos.

En mis artículos anteriores, exploré y comparé varias herramientas de IA, por ejemplo, el Agente de Ciencia de Datos de Google, ChatGPT vs. Claude vs. Géminis Para la ciencia de datos y Búsqueda profunda V3, etc. Sin embargo, este es solo un pequeño subconjunto de todas las herramientas de IA disponibles para Data science. Por ejemplo, algunas de las herramientas que he utilizado en mi trabajo:

- API OpenAILo uso para categorizar y resumir los comentarios de los clientes e identificar las debilidades del producto.

- ChatGPTyGeminiMe ayudan a redactar mensajes y correos electrónicos de Slack, escribir informes de análisis e incluso evaluaciones de rendimiento.

- Recolectar IA:Glean utilizó IA para encontrar rápidamente respuestas en documentos y comunicaciones internas.

- CursoryCopilot: Disfruto simplemente tocando tabulación-tab para completar automáticamente el código y los comentarios.

- Magia HexadecimalUtilizo Hex para hojas de cálculo colaborativas en el trabajo. También ofrece una función llamada Magia Hexadecimal Escribir código y corregir errores utilizando IA conversacional.

- Corteza de copo de nieveCortex AI permite a los usuarios invocar puntos finales LLM, crear RAG y servicios de texto a SQL utilizando datos en Snowflake.

Estoy seguro de que podrías añadir más a esta lista, y cada día se lanzan nuevas herramientas de IA. Es casi imposible obtener una lista completa en este momento. Por eso, en este artículo, me gustaría dar un paso atrás y centrarme en una pregunta más importante: ¿Qué necesitamos realmente como profesionales de datos y cómo puede ayudarnos la IA?؟

En la siguiente sección, me centraré en dos tendencias principales: eliminar las tareas de bajo valor y acelerar el trabajo de alto valor.

1. Eliminar tareas de bajo valor

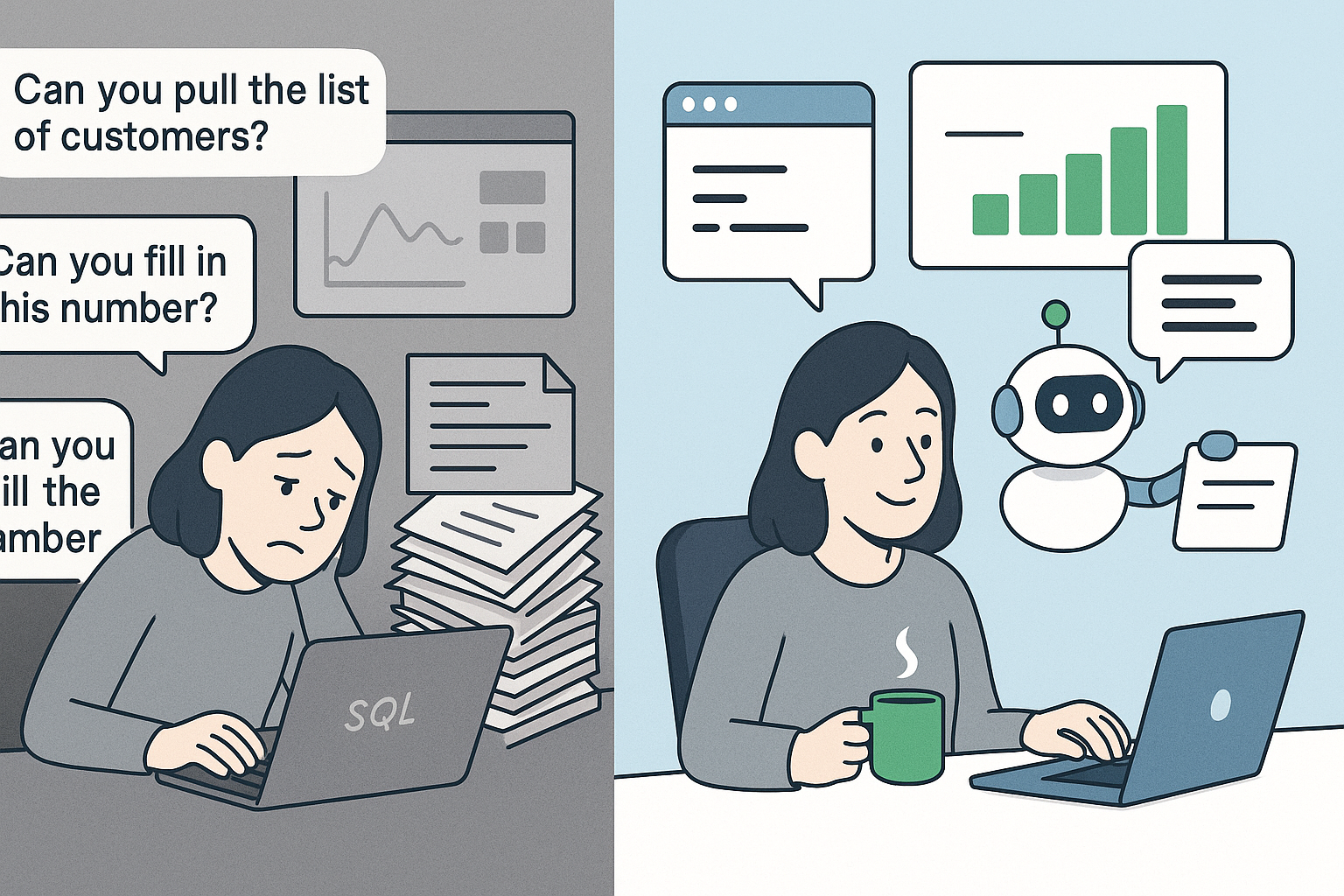

Me convertí en científico de datos porque realmente disfruto descubrir conocimientos comerciales a partir de datos complejos y tomar decisiones comerciales basadas en ellos. Sin embargo, después de haber estado en este campo durante más de 7 años, debo admitir que no todo el trabajo es tan emocionante como esperaba. Antes de que podamos realizar análisis avanzados o crear modelos de aprendizaje automático, hay muchos flujos de trabajo de bajo valor que son inevitables a diario y, en muchos casos, esto se debe a que no tenemos las herramientas adecuadas para permitir que nuestras partes interesadas realicen análisis de autoservicio. Veamos nuestra situación actual y el caso ideal:

Estado actual: Actuamos como intérpretes y guardianes de datos (a veces, “monos SQL”)

- Solicitudes de extracción de datos simples Ella viene a mí y a mi equipo a través de Slack todas las semanas y nos pregunta: "¿Cuál fue su valor bruto de mercancía (GMV) el mes pasado?" "¿Puedes obtener una lista de clientes que cumplan estos criterios?" “¿Puedes ayudarme a completar este número para la presentación que necesito dar mañana?”

- Las herramientas de inteligencia empresarial (BI) no son compatibles con los casos de uso de autoservicio.. Hemos adoptado herramientas de inteligencia empresarial como Looker y Tableau para que las partes interesadas puedan explorar datos y monitorear métricas fácilmente. Pero lo cierto es que siempre existe un equilibrio entre la simplicidad y la capacidad de autoservicio. A veces hacemos que los paneles sean fáciles de entender con unas pocas métricas, pero solo pueden servir para unos pocos casos de uso. Al mismo tiempo, si hacemos que la herramienta sea altamente personalizable con la capacidad de explorar libremente las métricas y los datos subyacentes, las partes interesadas pueden encontrarla confusa y carecer de confianza para usarla y, en el peor de los casos, los datos pueden extraerse y malinterpretarse.

- Los documentos son pocos o están desactualizados.. Esta es una situación común, pero puede deberse a varios motivos: quizás nos estamos moviendo rápidamente y nos estamos concentrando en entregar resultados, o no existen buenas políticas de documentación y gobernanza de datos. Como resultado, el conocimiento tribal se convierte en un cuello de botella para que las personas ajenas al equipo de datos puedan utilizar los datos.

Caso ideal: Permitir que las partes interesadas se autogestionen para que podamos reducir el trabajo de bajo valor

- Las partes interesadas pueden realizar extracciones de datos simples y responder preguntas básicas con facilidad y confianza.

- Los equipos de datos dedican menos tiempo a preparar informes repetitivos o consultas básicas únicas.

- Los paneles de control se pueden descubrir, interpretar y utilizar sin asistencia directa.

Entonces, para acercarnos al estado ideal, ¿qué papel puede desempeñar aquí la IA? Según lo que he observado, estas son las tendencias comunes hacia las que se dirigen las herramientas de IA para cerrar la brecha:

- Consulta de datos en lenguaje natural (texto a SQL)Una forma de reducir la barrera técnica es permitir que las partes interesadas consulten los datos en lenguaje natural. Existen muchas iniciativas de conversión de texto a SQL en la industria:

- por ejemplo, Copo de nieve Es una de las empresas que ha logrado un gran avance en Modelos Text2SQL Y comenzó a integrar la capacidad en su producto.

- Muchas empresas (incluida la mía) también han explorado soluciones Text2SQL internamente. Por ejemplo, yo participé Uber Su viaje con Consulta GPT de Uber Facilitar la consulta de datos a su equipo de operaciones. Este artículo detalla cómo Uber diseñó una arquitectura multiagente para generar consultas. Al mismo tiempo, también reveló desafíos importantes en este campo, incluida la interpretación precisa de la intención del usuario, el manejo de gráficos de tablas grandes, la prevención de alucinaciones, etc.

- Francamente, para que Text-to-SQL funcione, hay un nivel muy alto en el que debes hacer que la consulta sea precisa; incluso si la herramienta falla solo una vez, puede destruir la confianza y, eventualmente, las partes interesadas volverán a ti para validar las consultas (y luego necesitas leer y reescribir las consultas, lo que casi duplica el trabajo 🙁). Hasta ahora, no he encontrado una plantilla o herramienta de texto a SQL que funcione perfectamente. Lo considero alcanzable solo cuando se consulta un subconjunto muy pequeño de conjuntos de datos subyacentes bien documentados para casos de uso específicos y estandarizados, pero es muy difícil escalarlo para incluir todos los datos disponibles y diferentes escenarios comerciales.

- Pero, por supuesto, dada la enorme inversión en este espacio y el rápido desarrollo de la IA, estoy seguro de que nos acercaremos cada vez más a soluciones de texto a SQL precisas y escalables.

- Asistente de inteligencia empresarial (BI) basado en chatOtra área popular para mejorar la experiencia de las partes interesadas con las herramientas de BI es un asistente de BI basado en chat. En realidad, esto lo lleva un paso más allá que Text-to-SQL: en lugar de generar una consulta SQL basada en la solicitud del usuario, responde en un formato de visualización y también en un resumen de texto.

- Géminis en Looker Él es un ejemplo en este sentido. Looker es propiedad de Google, por lo que resulta natural que se integren con Gemini. Otra ventaja que tiene Looker para desarrollar su IA es que los campos de datos ya están documentados en la capa semántica de LookML, con asignaciones comunes definidas y métricas comunes incluidas en los paneles. Por lo tanto, contiene una gran cantidad de datos valiosos de los que podemos aprender. Gemini permite a los usuarios personalizar los paneles de Looker, hacer preguntas sobre los datos e incluso crear agentes de datos personalizados para análisis conversacionales. Aunque, según mi experiencia limitada con la herramienta, a menudo termina sin poder responder ni siquiera a preguntas simples. Avísame si tuviste una experiencia diferente y lograste que funcionara…

- Tableau también lanzó una función similar, Tableau IA. No lo he usado yo mismo, pero según la demostración, ayuda al equipo de datos a preparar datos, crear rápidamente paneles usando lenguaje natural y resumir información sobre los datos en Tableau Pulse para que las partes interesadas identifiquen fácilmente cambios en las métricas y tendencias anormales.

- Herramientas de indexación de datosLa IA también puede ayudar a superar el desafío de tener poca o ninguna documentación de datos.

- Durante un hackathon interno, recuerdo que uno de los proyectos de nuestros ingenieros de datos fue utilizar LLM para aumentar la cobertura de la documentación de la tabla. La IA puede leer la base del código y describir las columnas en consecuencia con gran precisión en la mayoría de los casos, por lo que puede ayudar a mejorar la documentación rápidamente con modificaciones y validación humana limitadas.

- De manera similar, cuando mi equipo crea nuevas tablas, comenzamos a pedirle a Cursor que escriba archivos YAML para la documentación de la tabla para ahorrarnos tiempo con resultados de alta calidad.

- También hay muchos catálogos de datos y herramientas de gobernanza que se han integrado con IA. Cuando busco en Google “índice de datos de IA”, veo logotipos de herramientas de indexación de datos como Atlan, Alation, Collibra, Informatica, etc. (Descargo de responsabilidad: no he usado ninguna de ellas). Esta es una clara tendencia en la industria.

2. Acelerar el trabajo de alto valor

Ahora que hemos hablado sobre cómo la IA puede ayudar a eliminar tareas de bajo valor, analicemos cómo puede acelerar proyectos de datos de alto valor. En este contexto, “trabajo de alto valor” se refiere a proyectos de datos que combinan la excelencia técnica con el contexto empresarial y logran un impacto significativo a través de la colaboración interfuncional. Por ejemplo, un análisis profundo que comprende los patrones de uso del producto y conduce a cambios en el producto, o un modelo de predicción de abandono de clientes para identificar a los clientes en riesgo de abandono y da como resultado iniciativas de prevención de abandono. Comparemos la situación actual con el futuro ideal:

Estado actual: Existen cuellos de botella en Productividad En el flujo de trabajo diario

- El análisis exploratorio de datos (EDA) requiere mucho tiempo.. Este paso es esencial para obtener una comprensión inicial de los datos, pero realizar todos los análisis univariados y multivariados puede llevar mucho tiempo.

- Tiempo perdido en codificación y depuración. Seamos honestos: nadie puede recordar todos los parámetros del modelo numpy, pandas y sklearn. Necesitamos buscar constantemente documentación mientras codificamos.

- Los datos ricos y no estructurados no se aprovechan plenamente.. Las empresas generan una gran cantidad de datos de texto todos los días a partir de encuestas, tickets de soporte y reseñas. Pero cómo extraer información de forma escalable sigue siendo un desafío.

Caso ideal: los científicos de datos se centran en el pensamiento profundo, no en la sintaxis.

- Escribir código se siente más rápido sin tener que buscar sintaxis.

- Los analistas pasan más tiempo interpretando resultados y menos tiempo trabajando con datos.

- Los datos no estructurados ya no son una barrera y se pueden analizar rápidamente.

Cuando ves el caso ideal, estoy seguro de que ya tienes algunas herramientas de IA en mente. Veamos cómo la IA puede realmente impactar o marcar una diferencia:

- Asistentes de IA para codificación y depuración. Creo que este es, por lejos, el tipo de herramienta de IA más confiable para cualquiera que codifique. Ya estamos viendo que esto sucede nuevamente.

- Cuando a los chatbots de LLM les gusta ChatGPTyClaudeLos ingenieros se dieron cuenta de que podían simplemente hacer preguntas de sintaxis o mensajes de error a un chatbot que obtendría respuestas muy precisas. Esto sigue siendo una interrupción en tu flujo de trabajo de codificación, pero es mucho mejor que hacer clic en docenas de pestañas de StackOverflow, y eso ya parece del siglo pasado.

- Más adelante, vemos surgir herramientas de codificación de IA integradas Plus y Plus: integradas Copiloto de GitHubyCursor Con su editor de código, pueden leer su base de código para sugerir de manera proactiva la finalización del código y la depuración de problemas dentro de su IDE.

- Como mencioné brevemente al principio, las herramientas de datos como Copo de nieveyHexagonal También incluye asistentes de codificación de IA para ayudar a los analistas y científicos de datos a escribir código fácilmente.

- Inteligencia artificial para el análisis y análisis exploratorio de datos. Esto es algo similar a las herramientas de asistente de BI basadas en chat que mencioné anteriormente, pero su objetivo es más ambicioso: comienza con conjuntos de datos sin procesar y tiene como objetivo automatizar todo el ciclo de análisis de limpieza de datos, preprocesamiento, análisis exploratorio y, a veces, incluso modelado. Estas son las herramientas que a menudo se anuncian como “reemplazantes de los analistas de datos” (pero ¿lo son?).

- Agente de ciencia de datos de Google Es una nueva herramienta muy impresionante que puede crear un Jupyter Notebook completo con una simple indicación. Escribí recientemente un artículo Explica lo que puede y no puede hacer. En resumen, puede crear rápidamente un Jupyter Notebook bien organizado que se ejecuta según un plan de ejecución personalizable. Sin embargo, carece de las capacidades para modificar un Jupyter Notebook en función de preguntas de seguimiento, todavía requiere alguien con sólidos conocimientos de ciencia de datos para revisar los métodos y realizar iteraciones manuales, y requiere una declaración clara del problema de los datos con conjuntos de datos limpios y bien documentados. Por lo tanto, lo veo como una gran herramienta para ahorrar tiempo en el código inicial, en lugar de amenazar nuestros trabajos.

- También se puede clasificar como Herramienta de análisis de datos ChatGPT Dentro de este ámbito. Permite a los usuarios cargar un conjunto de datos y chatear con él para completar su análisis, crear visualizaciones y responder preguntas. Puedes encontrar mi artículo anterior donde analizo sus capacidades. aquí. También enfrenta desafíos similares y trabaja mejor como asistente de EDA que reemplazando a los analistas de datos.

- Las capacidades de PNL son fáciles de usar y escalables.. LLM es muy bueno en las conversaciones. Por lo tanto, la PNL se ha vuelto mucho más fácil con el LLM actual.

- Mi empresa organiza un hackathon interno todos los años. Recuerdo que mi proyecto de hackathon de hace tres años consistía en probar BERT y otros métodos tradicionales de modelado de temas para analizar las respuestas de la encuesta NPS, lo cual fue divertido, pero, honestamente, muy difícil de hacer preciso y significativo para el negocio. Luego, hace dos años, durante un hackathon, intentamos... API OpenAI Clasificar y resumir los datos de retroalimentación funcionó a la perfección, permitiendo un modelado temático de alta fidelidad, análisis de sentimientos y clasificación de retroalimentación, todo con una sola llamada a la API. El resultado se adaptó perfectamente a nuestro contexto empresarial según las indicaciones del sistema. Posteriormente, creamos un flujo de trabajo interno que se expandió fácilmente para incluir datos de texto de respuestas a encuestas, tickets de soporte, llamadas de ventas, notas de investigación de usuarios, etc. Se convirtió en el centro de datos para la retroalimentación de los clientes e inspiró nuestra hoja de ruta de productos. Puede encontrar Plus en Este blog técnico.

- También hay muchas empresas nuevas que están desarrollando herramientas de análisis de comentarios de clientes, herramientas de análisis de reseñas de productos, herramientas de asistencia de servicio al cliente y más, impulsadas por IA. Las ideas son todas las mismas: aprovechar cómo LLM puede comprender el contexto del texto y llevar a cabo conversaciones para crear agentes de IA que se especialicen en el análisis de texto.

Conclusión

Es fácil dejarse llevar por las últimas herramientas de inteligencia artificial (IA). Pero en última instancia, lo que más importa es utilizar la IA para eliminar lo que nos frena y acelerar lo que nos hace avanzar. La clave es mantener el pragmatismo: adoptar lo que funciona hoy, mantener la curiosidad sobre lo que surge y nunca perder de vista el objetivo principal de la ciencia de datos, que es tomar mejores decisiones a través de una mejor comprensión.

Los comentarios están cerrados.