Mi experiencia personal: ejecutar un chatbot de IA real localmente en un iPhone

Chatbots impulsados por IA, como: ChatGPTyGemini...depender de la computación en la nube para funcionar. Pero ¿qué pasaría si pudieras ejecutar un modelo de lenguaje grande (LLM) directamente en tu iPhone, sin necesidad de suscripción, conexión a internet ni de que tus datos salgan del dispositivo? Gracias a un conjunto de aplicaciones y modelos ligeros y compactos, esto ya es posible.

Lo he probado yo mismo y esto es lo que necesitas saber.

Ejecutar IA localmente en el iPhone

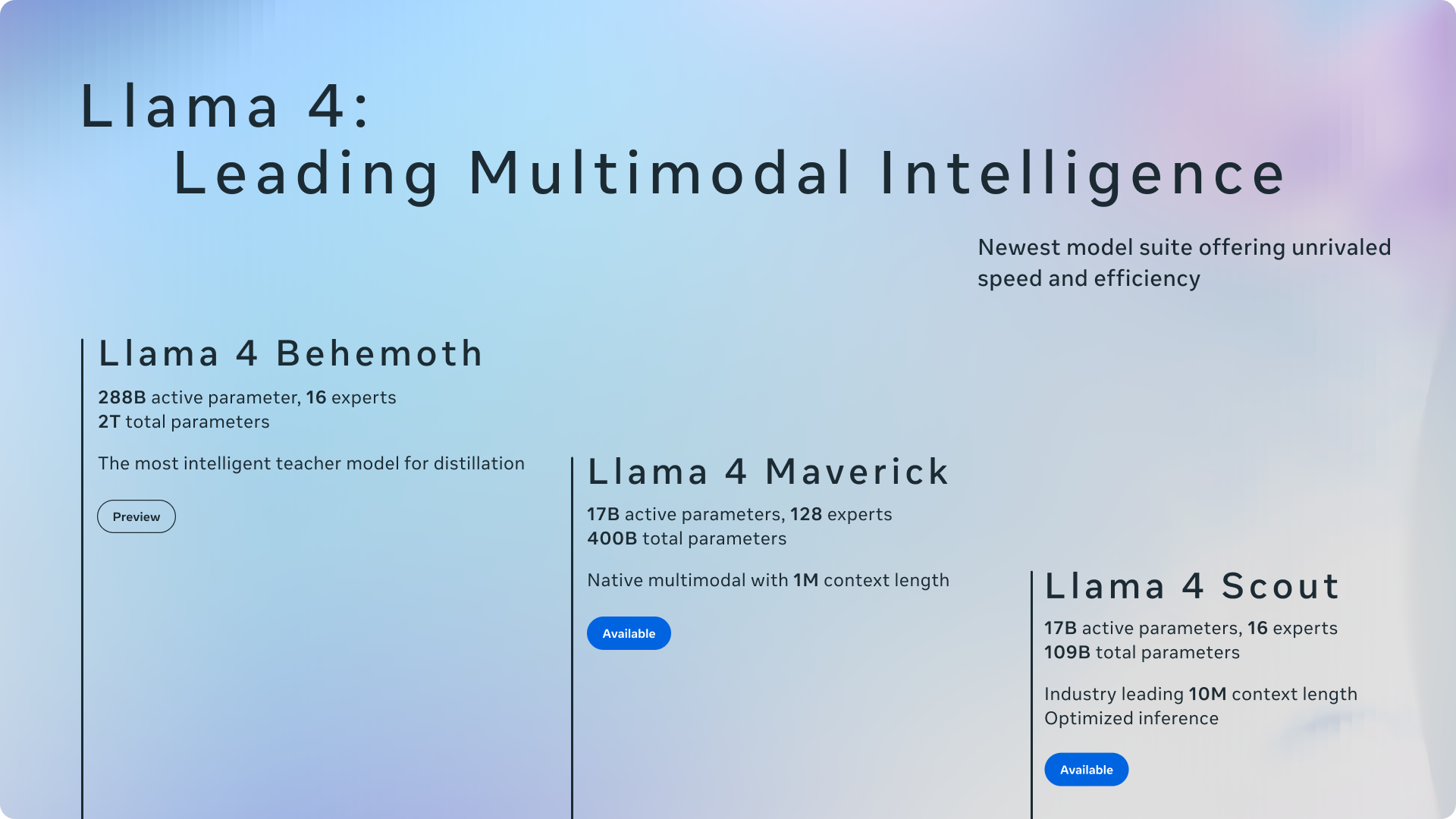

Ahora puedes ejecutar modelos de código abierto como LlamayQwen Directamente en iOS. Estos modelos se reducen mediante un proceso llamado cuantificación, que los comprime para que quepan en la memoria del dispositivo móvil sin afectar significativamente el rendimiento.

Pero hay un punto importante: el rendimiento depende en gran medida del dispositivo. Por ejemplo, el iPhone 15 Pro o el 15 Pro Max, equipados con el chip más reciente de Apple, pueden ejecutar modelos con hasta 7 u 8 mil millones de parámetros (como el Llama 3.1 8B), mientras que los teléfonos más antiguos son más adecuados para modelos más pequeños con parámetros de entre 1 y 3 mil millones.

Aplicaciones que lo hacen posible

- Granja LLM (Gratis): La forma más sencilla de empezar. Puedes descargar un modelo pequeño (como Phi-3.5 Instruct) y ejecutarlo sin conexión con un solo clic. Es sorprendentemente fluido para consultas rápidas.

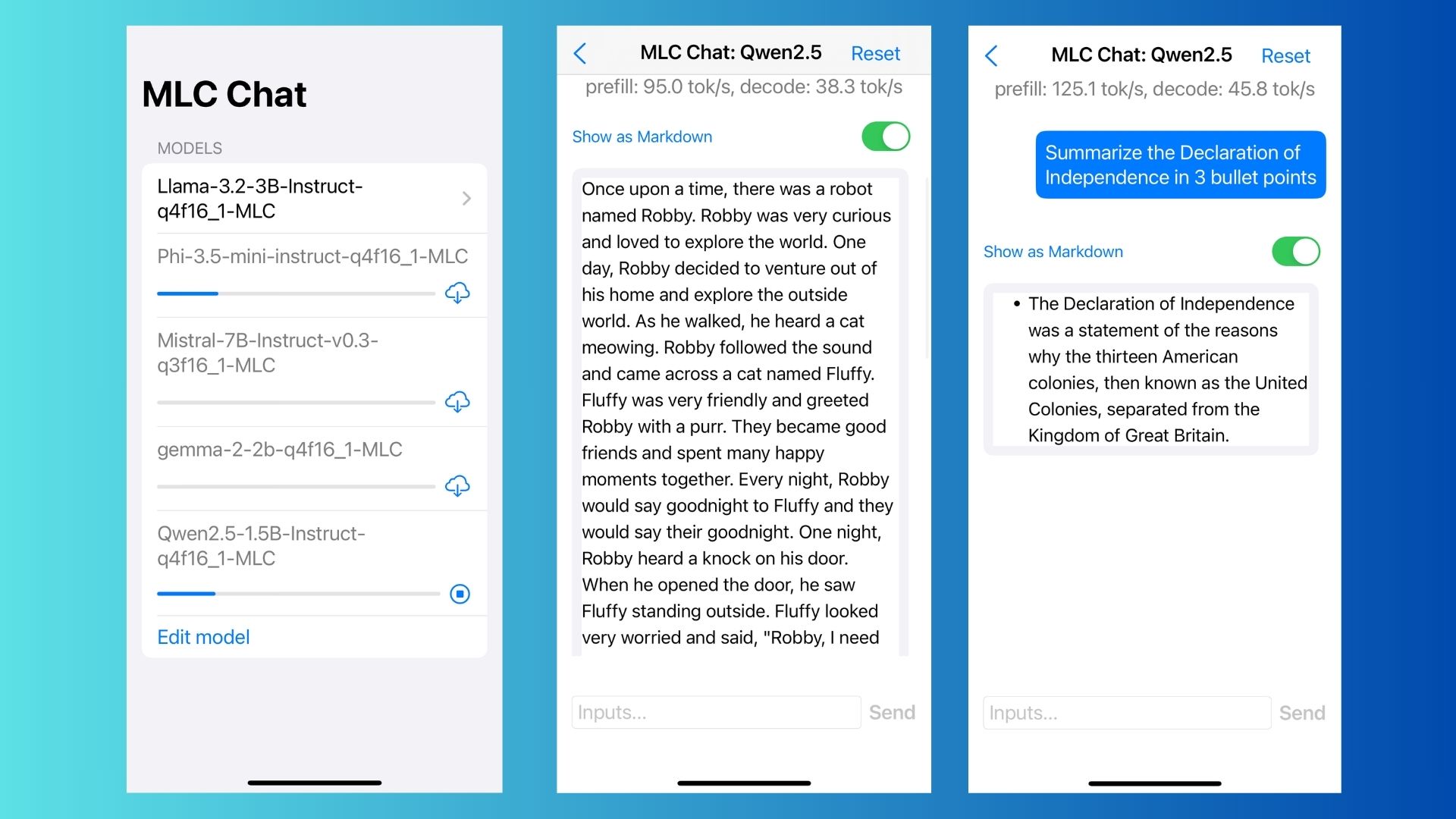

- Chat MLC (gratis):

Esta es la aplicación que usé. Quería probar LLM Farm, pero por alguna razón no estaba disponible para descargar en la App Store de Apple. Como es gratuita, la probé y funcionó a la perfección. - Maestría en Derecho Privada (Proyecto Comunitario): Esta opción es más un proyecto DIY que para el usuario promedio. Esta aplicación incluye guías detalladas para descargar modelos como Llama 3.1 y Qwen a tu iPhone. Si te gusta experimentar, definitivamente vale la pena probarla.

- Apolo (Pagado): He oído hablar muy bien de ella, pero no la he probado. Cuéntame en los comentarios qué te parece esta aplicación centrada en la privacidad.

Cómo ejecutar el modelo localmente

Después de descargar la aplicación elegida, ábrela. Desde allí, explora la lista de modelos integrados y selecciona uno (por ejemplo, Phi-3.5 Instruct Q4 cuantificado). Elegí Qwen 2.5 simplemente porque hacía tiempo que no lo usaba.

Una vez descargado, verás el formulario en tu dispositivo (su tamaño varía desde unos pocos cientos de megabytes hasta varios gigabytes). Desde ahí, simplemente empieza a chatear.

Deberá ser realista; este no es el momento de pedir análisis exhaustivos ni planes largos y detallados. Considere lo siguiente:

- la velocidad: Los modelos pequeños (entre 1 y 3 mil millones de parámetros) responden más rápido, mientras que los modelos grandes pueden tardar segundos por símbolo.

- Contexto: No pegue artículos enteros; mantenga las indicaciones más breves.

- Producción: Los modelos de idiomas locales grandes pueden ser menos precisos que ChatGPT, pero son útiles para tomar notas, resúmenes, preguntas y respuestas y borradores ligeros.

Me divertí probando algunas de las indicaciones. Nada complicado; solo quería ver qué tipo de respuestas obtenía de la solicitud local. Algo que notarás de inmediato es la velocidad. Es increíble lo rápido que responde un modelo de lenguaje grande.

Probé las siguientes afirmaciones y, en general, me gustaron los resultados.

- Resuma la Declaración de Independencia en tres puntos.

- “Escribe un cuento corto para dormir sobre un robot y un gato”.

- “Dame tres ideas para cenar con pollo, arroz y brócoli”.

Ejecutar un modelo de idioma local grande no es lo mismo que chatear con GatoGPT-5Ciertamente se siente simplista y rudimentario. Si lo intentas, recuerda que tus indicaciones sean breves, ya que las ventanas de contexto son mucho más limitadas que con la versión normal del chatbot. Notarás que las respuestas son más lentas si sobrecargas el modelo de lenguaje local.

¿Por qué harías esto?

- No hay cuotas de suscripción. No necesitas agotar tu crédito solo para intentarlo.

- Privacidad incorporada. Todo permanece en tu dispositivo.

- Sorprendentemente versátil. Me sorprendió muchísimo la cantidad de tareas que podía realizar la miniatura. Cada vez que ponía a prueba sus límites, superaba el desafío con facilidad.

La línea de fondo

Si tienes un iPhone 15 o posterior y quieres explorar cómo se ve la IA "desde dentro", empieza por ahí. Puede ser... Granja LLM O Chat de MLC Formas rápidas y gratuitas de empezar. Si te preocupa la privacidad, la aplicación... Apollo Vale la pena intentarlo. Si te gusta experimentar y personalizar, LLM privado Le permite profundizar en las configuraciones personalizadas.

Recuerda que estos no son los chatbots más potentes a los que estás acostumbrado, así que no esperes resultados como los de ChatGPT. Pero es genial y futurista ejecutar tu propia IA en tu iPhone.

Los comentarios están cerrados.