Los riesgos de la IA empresarial: alternativas a OpenAI y las instituciones detrás de los agentes de IA

Brechas de privacidad de datos, cumplimiento y confianza en las integraciones actuales de agentes de IA

“Espera… ¿estás enviando tus entradas contables a OpenAI?”

Esto fue lo primero que me preguntó mi amiga cuando se lo mostré. Sentir-Escribir, una aplicación de diario impulsada por inteligencia artificial que creé durante un hackathon en San Francisco.

Me encogí de hombros.

“Fue un hackathon con temática de IA y tuve que crear algo rápidamente”.

Ella no se perdió ni un momento:

Claro. Pero ¿cómo puedo confiar en lo que he creado? ¿Por qué no organizas tu propio LLM?

Eso me detuvo.

Me sentí orgulloso de lo rápido que se creó la aplicación. Pero esta pregunta, y las que siguieron, revelaron todo lo que creía saber sobre la construcción responsable con IA. Los jueces del hackathon también lo mencionaron.

Ese momento me hizo darme cuenta de lo irrespetuosos que somos cuando construimos con IA, especialmente con herramientas que manejan datos confidenciales.

Me di cuenta de algo más grande:

No hablamos lo suficiente sobre la confianza cuando construimos con IA.

Su respuesta se me quedó grabada. Georgia von Minden es científica de datos en la ACLU, donde trabaja estrechamente con cuestiones relacionadas con información de identificación personal en contextos legales y de derechos civiles. Siempre he valorado su perspicacia, pero esta conversación fue diferente.

Entonces le pedí que me lo explicara. ¿Qué significa realmente la confianza en este contexto? Especialmente cuando los sistemas de IA tratan datos personales.

Ella me dijo:

La confianza puede ser difícil de establecer, pero la gobernanza de datos es un buen punto de partida. Quién posee los datos, cómo se almacenan y para qué se utilizan son aspectos importantes. Hace diez años, habría respondido a esta pregunta de otra manera. Pero hoy, con la enorme capacidad de procesamiento y los vastos almacenes de datos, la inferencia amplia es una verdadera preocupación. OpenAI tiene un acceso tan amplio tanto a la computación como a los datos que su falta de transparencia obliga a ser cauteloso.

En lo que respecta a la información de identificación personal (PII), tanto las regulaciones como el sentido común indican la necesidad de una sólida gobernanza de datos. Enviar información de identificación personal en llamadas API no solo es arriesgado, sino que también podría infringir estas normas y poner en peligro a las personas.

Me recordó que cuando construimos con IA, especialmente sistemas que manejan datos humanos confidenciales, no solo estamos escribiendo código.

Tomamos decisiones sobre privacidad, autoridad y confianza.

En el momento en que se recopilan datos de los usuarios, especialmente algunos personales como entradas de diario, se asume una responsabilidad. No se trata sólo de lo que tu modelo puede hacer. Se trata de qué sucede con esos datos, a dónde van y quién tiene acceso a ellos. La gestión responsable de los datos del usuario aumenta la confianza del usuario y mejora la privacidad.

La ilusión de la simplicidad

Hoy en día es más fácil que nunca lanzar algo que parezca inteligente. Con modelos de lenguaje grandes (LLM) como OpenAI y otros, los desarrolladores pueden crear herramientas de IA en cuestión de horas. Las empresas emergentes pueden lanzar funciones “impulsadas por IA” de la noche a la mañana. ¿Qué pasa con las instituciones? Se está apresurando a integrar estos agentes en su flujo de trabajo.

Pero en medio de todo este entusiasmo, a menudo se pasa por alto una cosa: Confianza.

Cuando la gente habla de Agentes de IAA menudo se refieren a simples envoltorios alrededor de modelos de lenguaje grandes (LLM). Estos agentes pueden responder preguntas, automatizar tareas o incluso tomar decisiones. Pero muchos se construyen apresuradamente, con poca atención a la seguridad, el cumplimiento o la rendición de cuentas.

Utilice el producto únicamente para OpenAI No significa que sea seguro. En lo que realmente confías es en todo el pipeline:

- ¿Quién construyó la portada?

- ¿Cómo se manejan sus datos?

- ¿Su información está siendo almacenada, grabada o peor aún, filtrada?

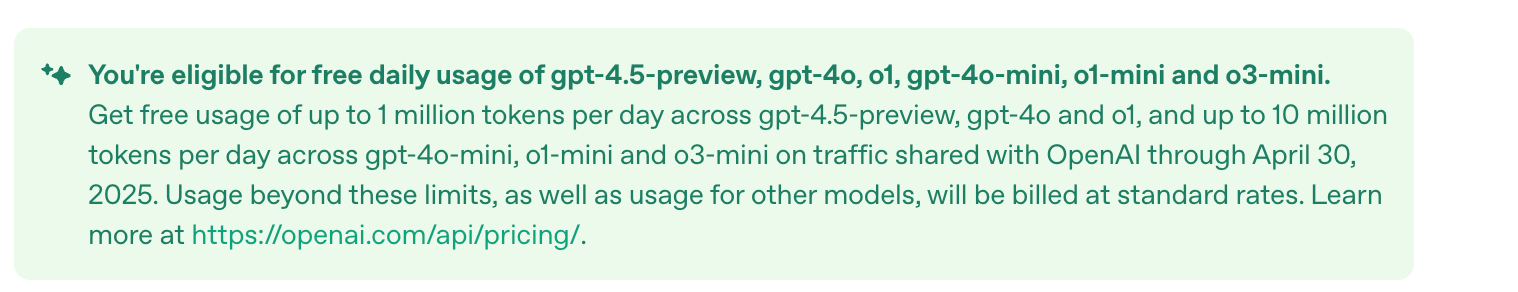

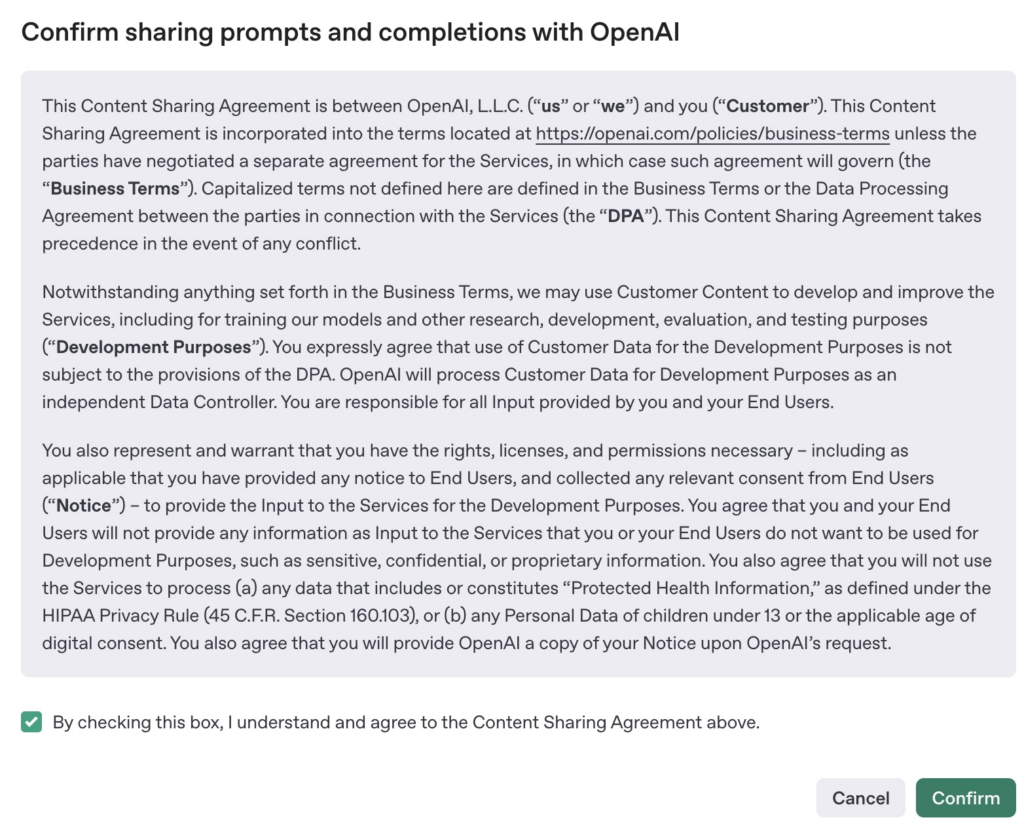

Yo mismo he estado usando la API de OpenAI para casos de uso de clientes. Recientemente, me ofrecieron acceso gratuito a la API (hasta 1 millón de tokens por día hasta finales de abril). Si acepto compartir los datos de mis reclamaciones.

Estuve a punto de aceptarlo para un proyecto personal paralelo, pero luego se me ocurrió: si un proveedor de soluciones aceptara el mismo acuerdo para reducir costos, sus usuarios no tendrían idea de que sus datos están siendo compartidos. A nivel personal, esto puede parecer inofensivo. ¿Pero en el contexto de la institución? Esto constituye una grave violación de la privacidad y posiblemente de obligaciones contractuales o regulatorias.

Sólo hace falta que un ingeniero diga “sí” a un acuerdo como este, y los datos de sus clientes quedarán en manos de otra persona.

La IA empresarial aumenta las expectativas

Veo que cada vez más empresas de SaaS y startups de herramientas de desarrollo experimentan con agentes de IA. Algunas están obteniendo buenos resultados, y algunos agentes de IA permiten a los usuarios incorporar sus propios modelos de lenguaje extenso (LLM), lo que les da control sobre dónde se ejecuta el modelo y cómo se procesan los datos. Este es un enfoque inteligente, especialmente a medida que la IA adquiere mayor importancia en las empresas.

Éste es el enfoque reflexivo: Tú estableces los límites de confianza..

Pero no todos están tan entusiasmados.

Muchas empresas simplemente se conectan a la API de OpenAI, agregan algunos botones y la llaman "lista para la empresa".

Advertencia: Esto no es cierto.

¿Qué podría salir mal? mucho.

Si integra agentes de IA en su infraestructura sin plantear las preguntas difíciles, estos son los riesgos potenciales:

- Fuga de datosSus reclamos pueden incluir datos confidenciales de clientes, claves API o lógica interna y, si se envían a un formulario de terceros, pueden quedar expuestos.

En 2023, los ingenieros de Samsung pegaron inadvertidamente el código fuente interno y notas en ChatGPT (Forbes). Estos datos ahora podrían ser parte de futuros conjuntos de entrenamiento, lo que supone un riesgo importante para la propiedad intelectual.

- Violaciones de cumplimientoEnviar información de identificación personal (PII) a través de un formulario como OpenAI sin los controles adecuados podría violar el Reglamento General de Protección de Datos (GDPR), HIPAA o sus contratos.

La empresa X de Elon Musk aprendió esto a las malas. Lanzaron su chatbot de inteligencia artificial, “Grok”, utilizando todas las publicaciones de los usuarios, incluidos los de la UE, para entrenarlo, sin la suscripción adecuada. Los organizadores intervinieron rápidamente. Bajo presión, dejaron de entrenar a Grok en la Unión Europea (Político).

- comportamiento vagoLos agentes no deterministas son difíciles de corregir o explicar. ¿Qué sucede cuando un cliente pregunta por qué un chatbot hizo una recomendación incorrecta o reveló algo confidencial? Se necesita transparencia para responder a esa pregunta y hoy en día muchos agentes no la ofrecen.

- Confusión sobre la propiedad de los datos¿Quién es el propietario del producto? ¿Quién registra los datos? ¿El proveedor de servicios se capacita nuevamente en sus insumos?

Zoom fue descubierto haciendo exactamente eso en 2023. Cambiaron silenciosamente sus términos de servicio para permitir el uso de datos de reuniones de clientes para entrenar a la IA (Fast Company). Tras una reacción pública, revirtieron la política, pero sirvió como recordatorio de que la confianza se puede perder de la noche a la mañana.

- Fallos de seguridad en el embalajeEn 2024, se encontraron expuestas a Internet decenas de implementaciones de Flowise, una popular herramienta de orquestación LLM de bajo código, muchas de ellas sin autenticación (Noticias de ciberseguridad). Los investigadores descubrieron claves API, credenciales de bases de datos y datos de usuarios al aire libre. Éste no es un problema de OpenAI: es un problema. Constructores. Pero los usuarios finales todavía pagan el precio.

- Funciones de IA que van demasiado lejosLa función "Recordar" de Microsoft, parte de su lanzamiento de Copilot, capturó automáticamente capturas de pantalla de la actividad de los usuarios para ayudar al asistente de IA a responder preguntas.DoblePulsar). Parecía útil… hasta que los expertos en seguridad lo señalaron como una pesadilla para la privacidad. Microsoft tuvo que dar marcha atrás rápidamente y hacer que la función fuera solo opcional.

No todo necesita OpenAI.

OpenAI es una plataforma increíblemente poderosa. Pero no siempre es la mejor solución.

A veces, un modelo local más pequeño es suficiente. Otras veces, la lógica basada en reglas funciona mejor. La opción más segura suele ser la que funciona completamente dentro de su propia infraestructura, de acuerdo con sus reglas.

No deberíamos simplemente conectar ciegamente un gran modelo de lenguaje (LLM) y llamarlo “asistente inteligente”.

En las instituciones, La confianza, la transparencia y el control no son extras opcionales. - Más bien, es esencial.

Cada vez hay más plataformas que permiten este tipo de control. Einstein 1 Studio de Salesforce ahora admite la función trae tu propio modelo, lo que le permite conectar su modelo de lenguaje grande (LLM) desde AWS o Azure. IBM Watson permite a las organizaciones implementar modelos internamente con registros de auditoría completos. Con MosaicML, Databricks le permite entrenar modelos de lenguaje grandes (LLM) privados dentro de su propia nube, para que sus datos confidenciales nunca abandonen su infraestructura.

Así es como debería ser la verdadera IA empresarial.

Conclusión

Los agentes de IA son increíblemente poderosos y permiten flujos de trabajo y automatización que antes no podíamos lograr. Sin embargo, la facilidad de desarrollo no significa necesariamente seguridad, especialmente cuando se trata de datos sensibles a gran escala.

Antes de comenzar a utilizar este nuevo y brillante agente, pregúntese:

- ¿Quién controla el modelo?

- ¿A dónde van los datos?

- ¿Estamos en cumplimiento con la normativa?

- ¿Podemos comprobar lo que está haciendo?

En la era de la inteligencia artificial, la mayor amenaza no es la mala tecnología, sino Confianza ciega.

Sobre el Autor

Soy Ellen, una ingeniera en aprendizaje automático con 6 años de experiencia, que actualmente trabaja en una startup fintech en San Francisco. Mi experiencia abarca funciones de ciencia de datos en consultoría de petróleo y gas, así como la dirección de programas de capacitación en inteligencia artificial y datos en Asia Pacífico, Medio Oriente y Europa.

Actualmente estoy completando mi Maestría en Ciencias de Datos (me graduaré en mayo de 2025) y estoy buscando activamente mi próxima oportunidad como Ingeniero de Aprendizaje Automático. Si estás abierto a una referencia o conexión, ¡te lo agradecería mucho!

Me encanta generar un impacto real en el mundo a través de la IA y siempre estoy abierto a colaboraciones basadas en proyectos también.

Los comentarios están cerrados.